人工智能正在加速改变世界

也在法律、就业、安全、道德伦理

等方面对其治理提出了新的要求

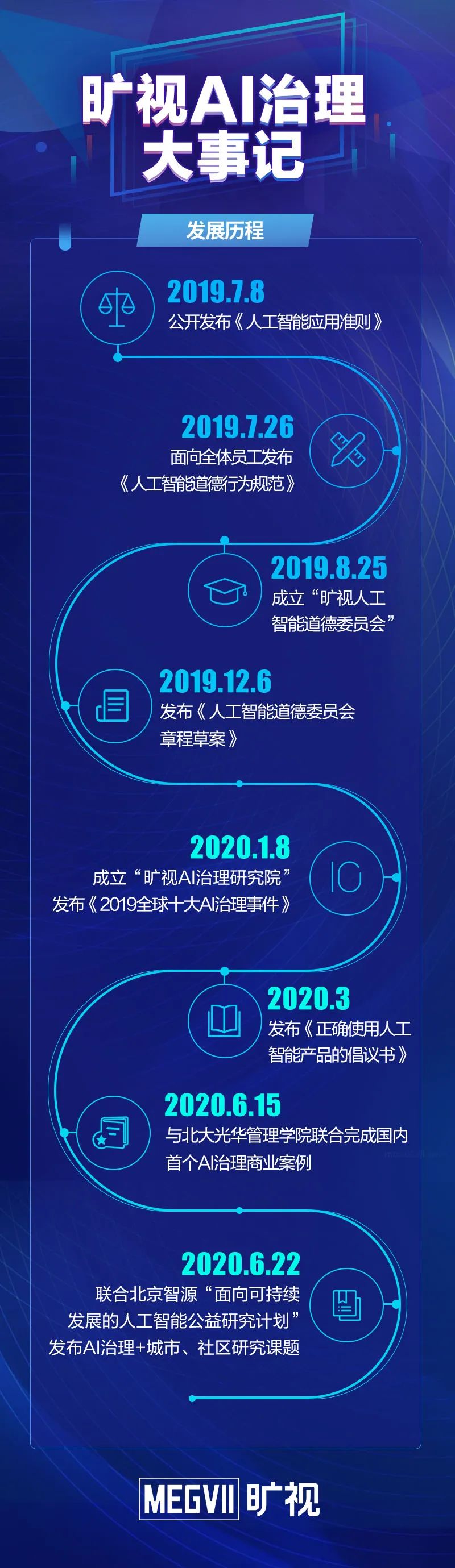

作为AI治理的先行者

旷视在去年7月发布《人工智能应用准则》

同期成立「旷视人工智能道德委员会」

旨在推动人工智能产业的健康发展

成为中国首家成立该项组织的AI企业

行正则致远,AI向善,行胜于言

在不断推进企业AI治理的这一年间

我们在机制建设、课题研究、内部落地、外部合作

等方面取得了一些阶段性进展

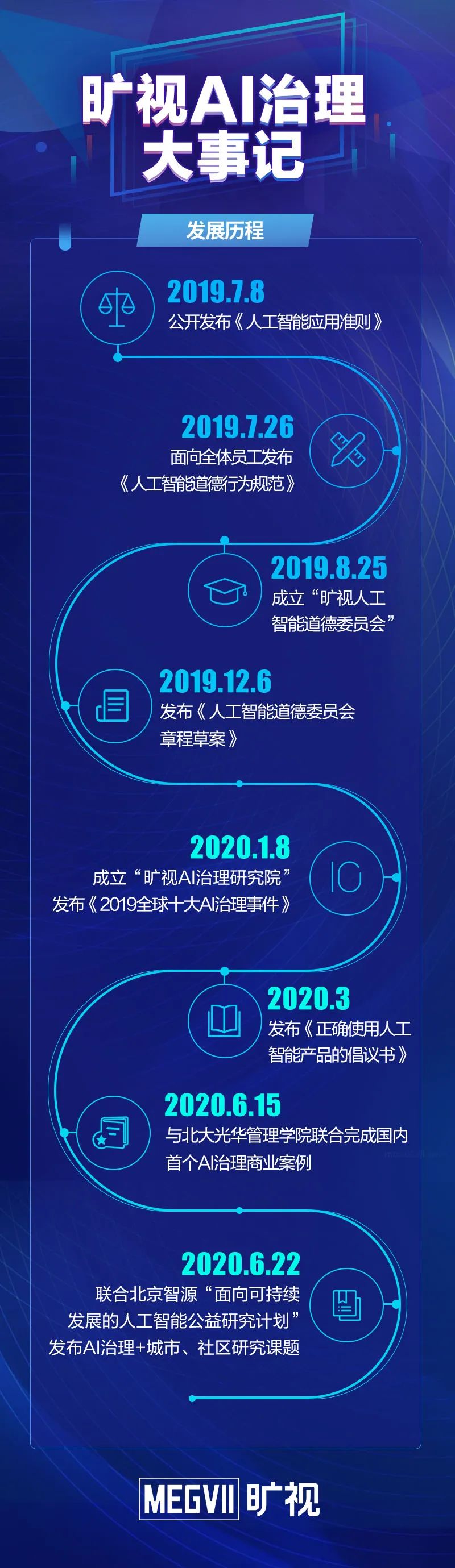

下面就让我们用一张图

回顾过去一年间旷视的AI治理大事件

👇👇👇

这张图既是对旷视AI治理的阶段性总结,同时我们也希望用这一年的成果激励自己,在AI治理的道路上继续稳扎稳打、砥砺前行。

与此同时,在近日的一次公开演讲上,旷视联合创始人兼CEO印奇以从业者和实践者的身份分享了旷视在AI治理方面的探索与实践,同时他还首次对外解读了旷视在过去一年多时间里,对于企业AI治理的深度思考。

在此我们将印奇演讲稍作整理,分享给大家(附完整演讲视频):

大家好,我是旷视印奇。今天非常高兴今天有机会代表人工智能的产业界跟大家分享一些人工智能企业对人工智能治理的一些思考。

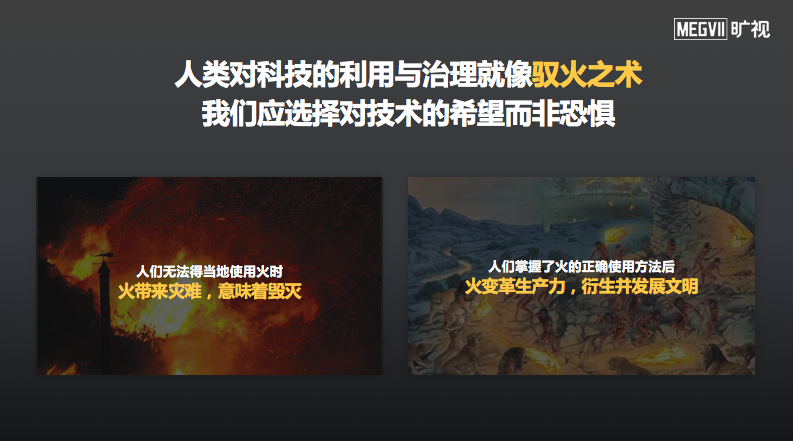

如果把人工智能和其他一些产业比较,比如把人工智能和互联网比较,互联网从1999年开始爆发到现在二十年时间,治理问题是在最近几年才被大家广泛提及,而人工智能这一波浪潮可能始于大概八到九年前,以深度学习的变革为核心。其实人工智能这个产业还是一个非常年轻的产业,为什么治理这个问题在这么早的阶段就被大家提及?可能是因为人工智能本身在技术创新和对社会的深度影响上,确实不同于之前的任何一次变革。所以我们内部一直讲,人工智能就像人类发明了用火一样,如何去善待和利用好这样一项技术,对这个产业的发展非常重要。从企业角度来看,我们认为负责任的AI就是可持续发展的AI,作为一个企业来说这其实是从一个非常务实的角度来思考。第一个例子,大概五年前,在全球范围内,旷视首次将人脸识别应用在金融行业。当时的人工智能其实没有任何行业标准和法律界限,所以那时候我们一个大的逻辑就是“边发展边治理”。那个时候虽然没有很明确的标准和法律界限,但是真正将这样一项技术产业化落地,并改善大家的生活,成为了当时旷视的核心动力。而五年的发展之后,刷脸技术已经应用到我们生活的方方面面的时候,这个时候我们发现除了它的商业价值之外,就要更关注它真正所面临的社会问题、法律问题和治理问题。所以作为一家人工智能企业,当我们在谈治理时,可能不是从太宏观或者太理论的层面来看待这个问题,而是我们日常每天的企业经营、我们每一个产品的设计、我们每一个客户合同的签订,到底和治理有什么关系。这是第一个维度。第二,既问输赢,也问对错。作为企业,特别是在自己的产品设计理念里面寻求改变,要既问输赢,也问对错。去年7月份,旷视设立了中国首家企业级“人工智能道德委员会”。我们做的第一件事情就是思考当大家讲人工智能治理的时候,民众、业界到底关注什么样的问题。旷视在做人工智能治理时有两个非常重要的逻辑,一个是务实,另一个就是研究驱动。所以我们在去年时,把过去一年全球所有跟人工智能治理相关的问题做了一个大汇总,并且在微博上,把大家最关注的十个问题以群策群力的方式做了筛选,得到了各个行业人群的深度参与,包括用户、研究机构、政策制定方等等。而在这样一个大的人工智能治理问题总结之后,我们又归纳出了四个大方向的问题,并将这四个问题作为旷视人工智能治理后续的指导纲领。这四个问题想在这里简单给大家介绍一下,并举相应产业中的例子:当我们把人脸识别应用在越来越多领域时,这里一个最重要的问题就是涉及到大家的肖像权的数据确权问题。这不仅是法律的讨论,更重要的是关乎到很多在真正的商业产品设计当中的合同签订,包括可能真正在法律确权过程中以及后面法律纠纷中所涉及的问题。在这里我们做了大量的工作,核心就是从一个技术、一个产品出发,真正探讨它最相关的法律本质问题。

旷视的产品与解决方案一共聚焦三大领域,物流和制造便是其中之一。AI之于物流和制造,一定程度上可以抽象简化成——用机器人替代部分人工,以提高整体效率。而这时大家就会十分担心人工智能时代会不会有大量的工作真正被机器人所取代?其实当我们真正深化去看这些问题时,会发现其实人工智能所替代的这些很多劳动岗位,包括能被大量应用的领域,往往和我们现在劳动力的短缺形成非常好的互补。如果回头来看,在历史上,人工智能领域,如机械臂的应用,最早就是在汽车行业喷涂环节里,是因为人类可能无法在那样一个对人体有害的环境中长期作业。同理,物流企业往往需要将仓库建设在距离城市一百公里以外的大空地,然而其实大量的年轻人,80、90后、00后,他们更愿意在一个大城市中生活,这时便产生了社会就业与企业招聘之间的矛盾。一方面大量人口就业是需要解决的棘手问题,另一方面越来越多的工厂、越来越多的仓库其实招不到合适的长期工作的工作人员。在这样的情况下,使用人工智能包括新一代机器人去改变制造业、改变物流行业,实际上便能与现在的部分岗位劳动力短缺形成互补。因此当我们在泛泛谈论人工智能取代大家的工作或者会造成更多失业时,如果能更深入产业观察,会发现,技术往往能够替代和互补很多产业中的发展问题。做一个企业,我们所做的研究一定是基于现实的场景和我们真正有的数据,同时希望当大家谈到人工智能治理的时候,真正能有鲜活的例子,发现人工智能治理可能不是一些概念、不是一些理论,而是一些真正需要去解决,并且解决之后会有非常大价值的产业问题。当提到人工智能时,早期大家认为算法是最重要的,后期认为计算能力是最重要的,到现在越来越多的人认为核心数据是最重要的。但是,很多人工智能的核心问题是无法通过一家企业或者一个行业的数据来打通的,需要有一个非常好的数据交换、定价和商业模式。这不仅要求产业内企业间的良心商业互动,更需要从法律层面、从国家标准层面,真正让人工智能应用的权益分配问题得到有效解决。

因为旷视最早进行商业化落地的算法就是人脸识别,并且人脸识别是跟大家日常息息相关的应用。我们在互联网上已经存在非常多的数据隐私问题,但当人脸识别、当人工智能涉及到线下,在物理世界中面临这样问题时,我们对它会加倍的谨慎、加倍的重视。

当前,虽然各个国家的人工智能发展阶段、关注的问题以及文化背景都不甚相同,但以上这四个方向却是共通的。如何能够通过产业界以自下而上的方式真正找到那些重要的问题,并且集结产业、技术、产品、法律、社会学、经济学等各个方面的力量,让专家、研究机构真正切中要害地解决这些问题,是旷视研究院、旷视人工智能道德委员会和旷视人工智能治理研究院希望能起到的促进作用。在企业内部,旷视也进行了一系列机构和制度建设,设立人工智能治理研究院,与清华大学、北京大学,包括北京智源研究院等很多外部机构共同建设一些科研课题,并从研发学术、产品工程、客户渠道和运营管理四个方面开展了务实的工作,从而实现在日常工作中自我管理、自我约束。从技术角度,我们在3月份开源了天元(MegEngine)深度学习框架,我们非常希望用人工智能深度学习的训练能力,嫁接客户的数据能力,为他们打造属于他们的技术算法。

但难点在于,越高价值的数据越越难脱离用户的生产场景,如何通过远程算法训练和学习确保多方能够参与到这样的数据共享中,但这个数据权利又不交换,同时各方能确保一个合理和合适的方式来分享最后研究的成果,成了关键。所以我们就将前沿的“联邦学习”应用在我们金融风控等领域里面,也产生了一些阶段性的成果。其实每一个人工智能治理的话题后面都有一个非常聚焦、非常具体的人工智能技术问题需要被解决,而只有通过技术的方法去解决技术的问题,才是真正未来技术创新的一条必经之路。从治理本身,去年旷视发布了《旷视人工智能应用准则》,为了让我们的合作伙伴、行业内上游、下游之间都关注到,我们内部做了一份“正确使用人工智能产品的倡议书”。

未来,我们希望当每个用户或每个合作伙伴打开我们的产品时,他看到第一页纸是这样的一份倡议,一个呼吁,让大家真正知道人工智能产业的良性发展,需要我们真正把人工智能用来造福大众,创造美好,而不是科幻片里和电影里面那样一个让人害怕、让人恐惧的存在。在很多企业里,人工智能治理是一个相对微观而具体,且细水长流的一项工作,但正因为有了这些工作,才真正能让人工智能治理发生点滴的改变。我们内部用四个方式,从产品、研发、客户到运营,同时结合旷视自身产业的格局,在AI治理加一些具体行业,跟不同的研究机构,包括外部企业,达成一些战略性合作,包括“AI治理+社区”、“AI治理+城市建设”,“AI治理+可信任AI”和“AI治理+企业自治”等。最后,人工智能治理,需要深入到行业的实践当中。例如在城市治理中,北京、上海这样的超大城市,可能都面临着交通枢纽人流过大的问题。从城市管理者的角度来看,需要人工智能技术提升交通枢纽的人员通行效率,同时预防范安全隐患。但从用户来看,如果真的有用户很在意自己的肖像权,不愿意使用刷脸通行,那么未来的城市建设该如何从人工智能治理的角度去架构城市的基础设计?这些可能都是企业、政府建设者,包括相应行业人士都要一起去思考的问题。我每次来上海,包括在北京机场,会发现人脸识别的口岸和通关设备越来越多,这可能就是我们当前需要去思考和解决的问题。我们在企业践行倡议的同时,认为在未来AI可持续发展过程中,以下四方面在全球交流和协作过程中特别重要:1、加强全球交流与协作。现在全球范围内,人工智能高速发展,东西方在治理、在伦理、在法律的边界上都有文化的差异性,加强全球交流与协作,才能真正促进人工智能的技术创新和共同创造。2、协同探索、实践引导。因为治理问题其实是一个非常长期的问题,而只有更多的企业从实践角度出发才能提出更好的问题,才能让我们的行业专家、让我们的教授们、让真正这些宏观的研究学者们有一个更好的牵引和更实际问题的落地。3、发展可信性技术。技术的问题需要通过技术来解决,所以我们认为发展可信性技术非常非常重要。4、完善自身规范。人工智能治理确实需要由每个企业从点滴的自我约束做起。这也是为什么旷视虽然年轻,但非常愿意也非常敢于作为带头的人工智能企业站出来,我们希望企业都能够务实的、实践的关注人工智能治理。- 不对立,我们并不会把人工智能技术的发展、商业的应用,本质的跟治理、跟法律的制定、标准的制定对立起来,相反,可能越多的交流,越能让这个产业的发展良性化、健康化、可持续化。

- 行胜于言,旷视特别强调技术信仰、价值务实,我们做每件事情都希望能反映到日常的工作当中。

旷视的使命是“用人工智能造福大众”,我们也希望通过人工智能治理的实践和人工智能治理的更多倡议,真正为这个行业带来一些新的变化。我感到非常高兴的是,从去年7月份开始,看到越来越多的同行在做类似的事情,包括他们可能在很多方面在学习旷视的一些内部架构和实践,我想这就起到了旷视真正深度参与人工智能治理的初心。我也非常期待各个行业的各位专家能够深度地结合我们在人工智能领域的很多实践,来一起研究人工智能的治理问题。旷视非常愿意、也非常开放,希望有更多专家来找我们,帮助我们解决更深层次的问题。