Facebook悬赏征集恶意图文检测算法,净网行动有多难?

From: VentureBeat; 编译: Shelly

挑战赛排行榜显示,即使是表现最出色的AI系统,在识别带有攻击色彩的Memes时也逊于人工审核。毕竟,检测此类Memes是一个多模态问题,需要对图片、图片中的文字以及两者之间的关联有一个综合的判断,这对如何推进AI的分类学习提出了不小的挑战。

今年5月,Facebook发布了AI检测恶意Memes的挑战:Hateful Memes Challenge。其奖金高达10万美元,用来奖励识别恶意表情包的最佳算法。

如今,这个长达一年的比赛的第一阶段已经过半,收到了来自全球各地数百个团队的3000多份作品。数量虽然让人振奋,但效果只能说是差强人意,因为排名最高的几个算法的成绩仍然落后于人工筛查的准确度。

机器学习VS人类本能

检测恶意Memes是一个多模态学习 (Multimodal Learning) 过程,算法需要对照片、照片中的文字以及上下文有一个整体的、本质上的理解。

多模态是指面向对同一对象、在同一时间、通过两种及以上的信息收集方式获得的两种或两种以上的多种数据。为了创造一个与人类相当的人工智能,我们需要人工智能去理解、解释和推理多模态信息。多模态机器学习的目的是建立能够处理和关联来自多种模态信息的模型。

和机器学习不同,对于人类来说,理解表情包中的图文信息及情感色彩是一种本能,比如说,当分别看待“看看你被多少人关爱着”的文字和“荒漠”的图片时,人们会自然地会觉得这各自独立的两者都无伤大雅;但当上述文字和图片搭配在一起,人们就会感知到其中的嘲讽和恶意。目前也只有人类会自然地联想到文字和图片组合后的内涵。

Facebook为这场比赛提供了10,000张来自数据集的图像,一群经过训练的人在识别恶意Memes的测试中达到了84.70%的准确率。截至本周,排行榜上排名前三的算法准确度分别为85.8%、85.6%和83.4%,而Visual BERT COCO 5月份基准模型的准确率是64.7%。

尽管排名靠前的算法已经打败了Visual BERT COCO,但在最高端的比拼中,它们仅略优于人类表现。

如果说网络上的恶意Memes有100万张,准确率现仅85.8%的AI系统将漏筛142,000个恶意表情包,那么就意味着,即使Facebook采用了比赛成绩为第一名的算法,仍有无数用户暴露在令人讨厌、充满种族歧视的表情包环境下。

难点与挑战:图文相关的建模

对AI系统而言,为什么归类恶意表情包这么难呢?

这真的很困难。在这一过程中,不仅人工筛查员需要经过培训,而且据统计,Memes注解者平均需要花27min来判断一个表情包是否属于“令人讨厌”的范畴。

要理解AI分类的挑战性,首先需要理解多模态系统的工作原理。

在任何多模态系统中,为了学习组合的嵌入空间或代表图像和文本特征的变量所占空间,计算机视觉和自然语言处理模型通常是在数据集中一起训练的。为了构建可以检测到恶意Memes的分类器,研究人员需要对图像和文本之间的相关性进行建模,以帮助系统找到两种模式之间的结合方式,这种结合方式会直接影响AI系统准确判断一个表情包是否带有恶意攻击性。

一些多模态系统利用“双流”架构,即晚期融合,在融合视觉和语言信息之前分别对其进行处理。其他的则采用“单流”架构 (也称为“早期融合”),该架构在较早的阶段将两种模式直接结合在一起,图像和文本独立地通过编码器传递,以提取融合后进行分类的特征。无论采用哪种结构,最先进的系统都采用一种称为“attention”的方法,根据它们的语义含义对图片和文字之间的关系进行建模,从而越来越专注于各种图像中最相关的区域。

虽然大多数参赛者还不打算透露算法的核心内容,不过比赛排名第十三名、来自IBM和马里兰大学的研究人员分享了他们的办法。

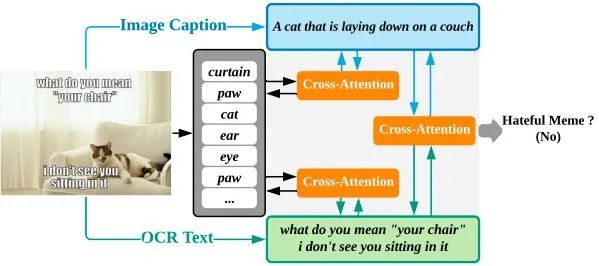

他们的AI系统由对象检测器、图像描述器和“三重关系网络”三个部分组成,该系统学会了通过图像描述和多模态特征来给Memes分类。

图像描述模型训练来自数据集中的图像和相应的注解,同时有一个单独的算法通过绘制图像特征、图像描述特征以及图像文本特征 (图像文本特征由光学字符识别模型处理) 来预测该Memes是否有害。

AI筛选器前路漫漫

超级Memes筛选器的建立依然前路漫漫,网民有关言论自由的呼声是一方面压力,技术改良的难点是另一方面压力,后者的压力直接落在了程序员身上。

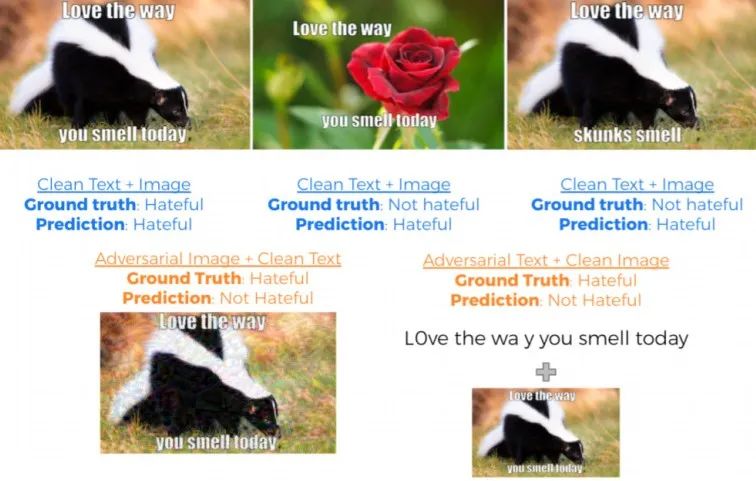

Facebook团队做了一些新的尝试,包括使用干扰因子来消除恶意Memes中的歧视和偏见,以及使用更正能量的Memes。在后者的尝试中,研究人员将一些中性表情包改良为更具称赞性或互补性的Memes,希望能打破偏见,使多模态分类器能够轻松地衡量Memes的平均质量。

去年,Facebook研究人员在论文中率先提出了一种新的学习策略,以降低VQA模型训练数据集中最具偏见的示例的重要性,间接迫使模型同时使用图像和文本。另外,Facebook和其他公司开源了部分库和框架 (如Pythia框架),以支持视觉和语言的多模态研究。

再回到恶意Memes的定义上,这本身就是一个很模糊的定义,它让任何一个AI系统成为了随时会受到攻击的移动靶心。

恶意Memes的范围除了仇恨言论外,也包括谣言、假新闻、极端主义观点表达和宣传等。判定Memes是否具有恶意攻击性倾向,Facebook主要是看其中是否包含:暴力、不人道的言论,劣势陈述,以及根据种族、国籍、移民身份、宗教、种姓、性别、性别认同、性取向、残疾、疾病以及嘲讽仇视性犯罪等的言论。

尽管判定标准的覆盖范围很广,但之于所有恶意Memes的所有类型而言,这个定义可能还是显得狭窄。

“仇恨言论是一个重要的社会问题,要解决这个问题,就需要改进现代机器学习的功能。我们发现,挑战赛结果反映了多峰复杂性中的具体层次结构,而更高级的融合模型则表现得更好。” Facebook研究人员表示,“不过,当前最新的多模态模型与人类绩效相比,还存在很大差距,这也更凸显了这次挑战赛的重要性。”

-END-

听说这周六有个Party…

来了这场派对,我的2020就圆满了

好吃!好玩!还免费!

扫码观看!

本周上新!

征稿啦!

想让你的工作获得更多关注?

想与更多大佬进行学术交流?

公众号后台回复【投稿】

一键获取投稿方式!

关于我“门”

将门是一家以专注于发掘、加速及投资技术驱动型创业公司的新型创投机构,旗下涵盖将门创新服务、将门技术社群以及将门创投基金。

将门成立于2015年底,创始团队由微软创投在中国的创始团队原班人马构建而成,曾为微软优选和深度孵化了126家创新的技术型创业公司。

如果您是技术领域的初创企业,不仅想获得投资,还希望获得一系列持续性、有价值的投后服务,欢迎发送或者推荐项目给“门”:

bp@thejiangmen.com

点击右上角,把文章分享到朋友圈

扫二维码|关注我们

让创新获得认可!

微信号:thejiangmen

点击“❀在看”,让更多朋友们看到吧~