DenseNet发明者黄高:动态模型好在哪里?

以下文章来源于智源社区 ,作者贾伟、周寅张皓

【智源社区】是北京智源人工智能研究院打造的一个内行、开放的 AI 实名社区,致力于促进 AI 交流。

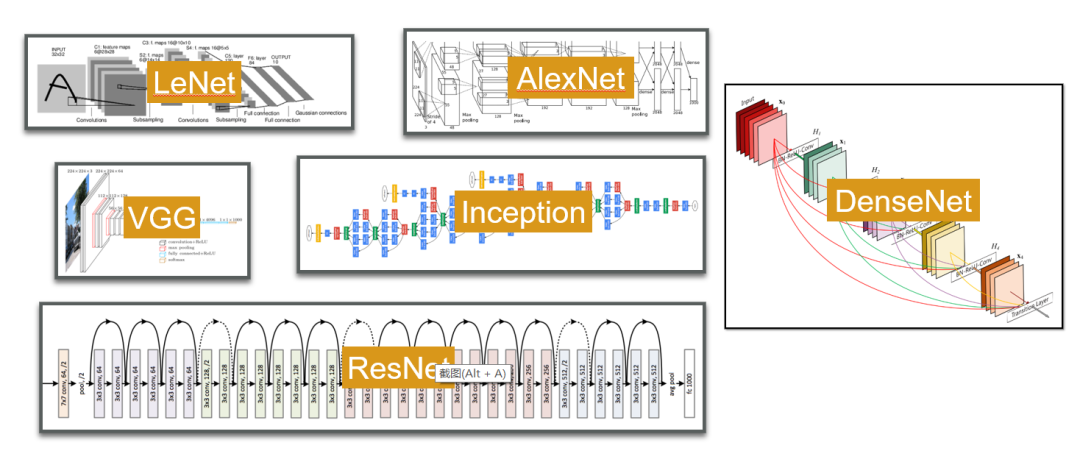

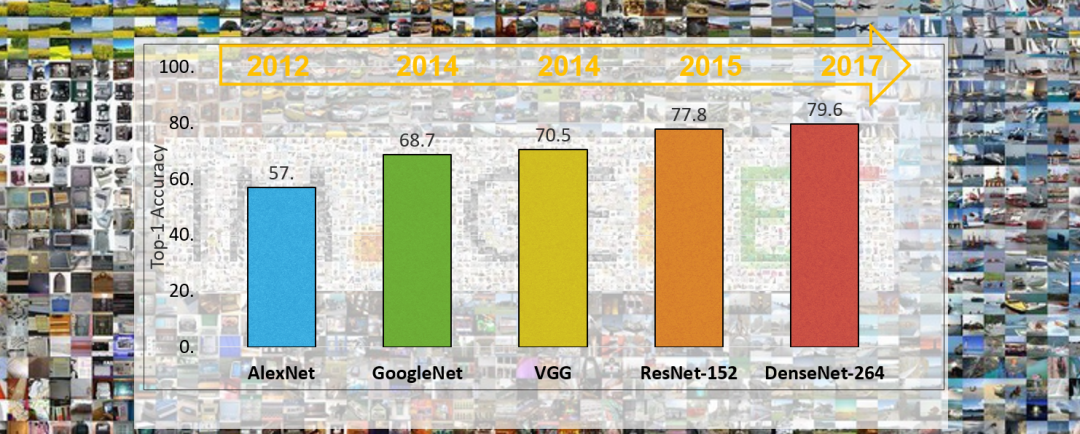

视觉模型的发展

表达能力:不同网络结构,其表达能力显然不同。举例来说,线性模型,无论多深,仍然只是线性模型,其表达能力有限。

优化性能:ResNet出现之前,所谓的“深度网络”并不很深,当时最深的GoogleNet、Inception等也仅 20 多层。这并非当时硬件不足,主要原因是梯度反传过程会出现梯度消失问题。ResNet以及后续的DenseNet通过结构上的改进,可以很好地改善这种问题。

泛化性能:从本质上来说,神经网络是一个函数,训练网络即是拟合。网络的结构定义了函数的特性,同时也关系到它的泛化能力。

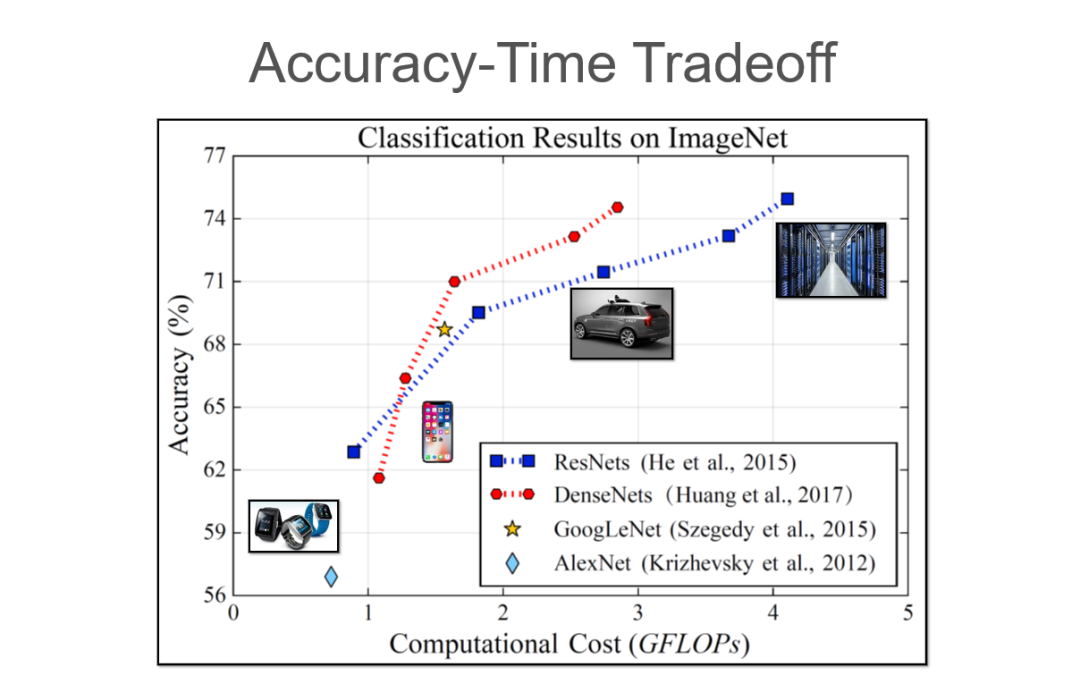

计算/存储效率:当达到同样精度时,有的模型需要很大,有的模型却比较小;有的模型消耗计算资源很高,有的模型却相对要小得多。

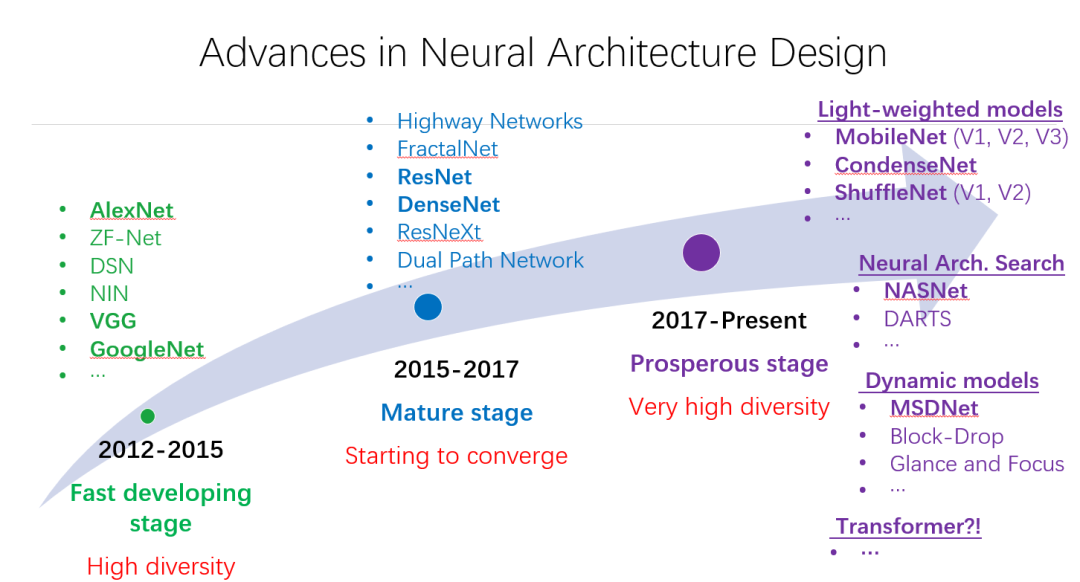

神经网络结构三个阶段

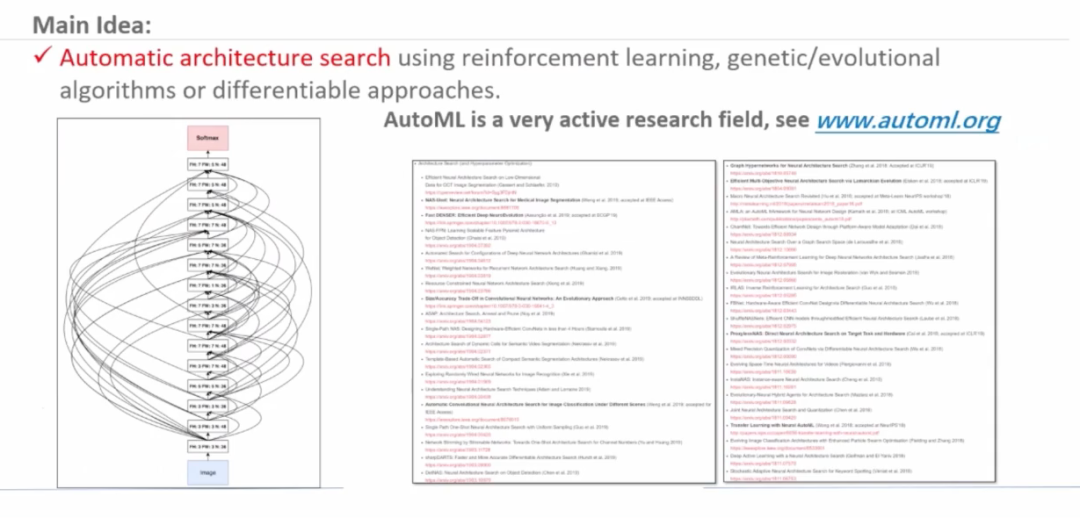

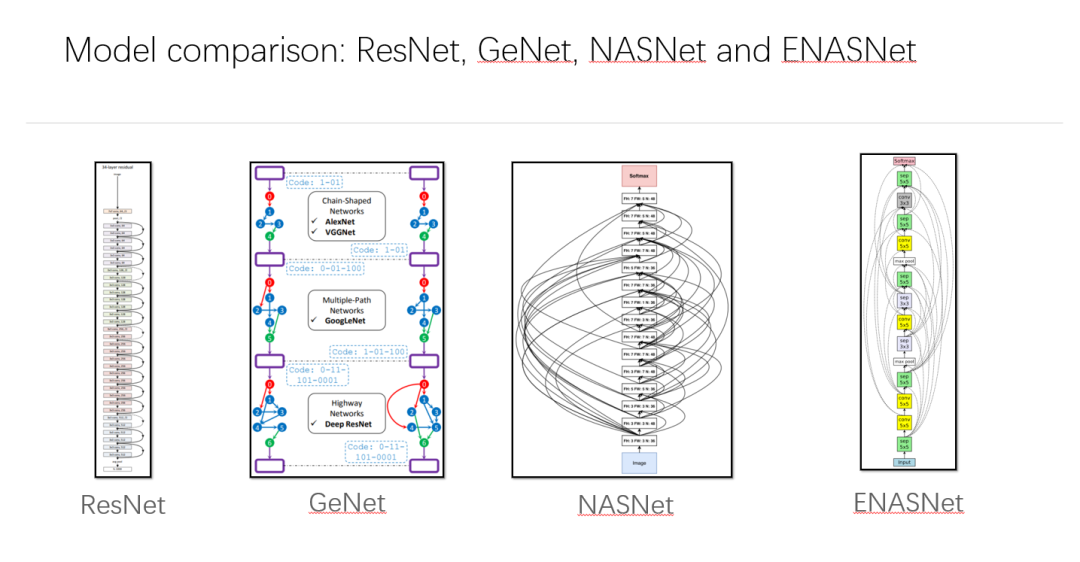

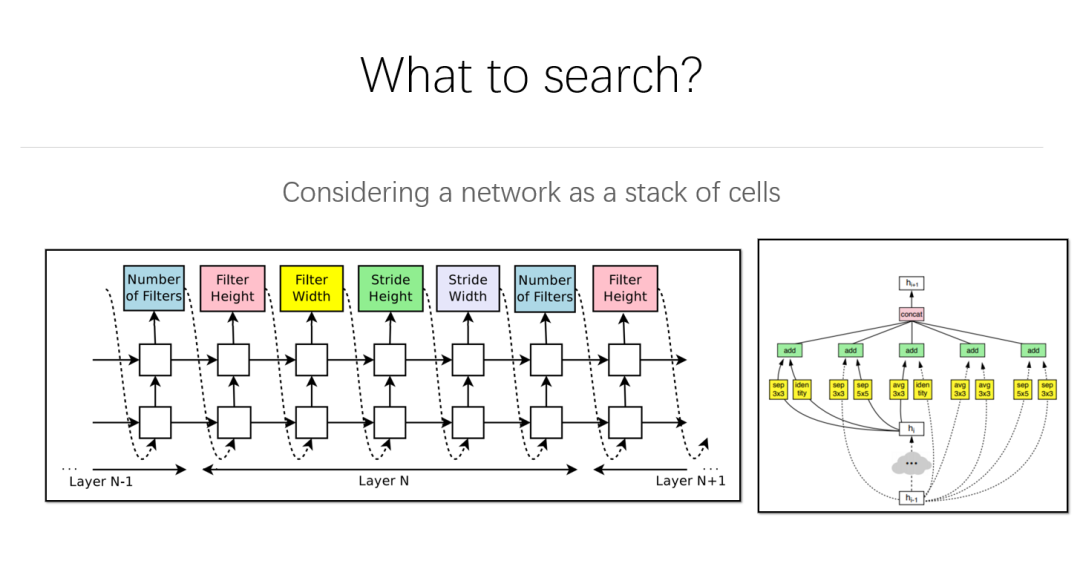

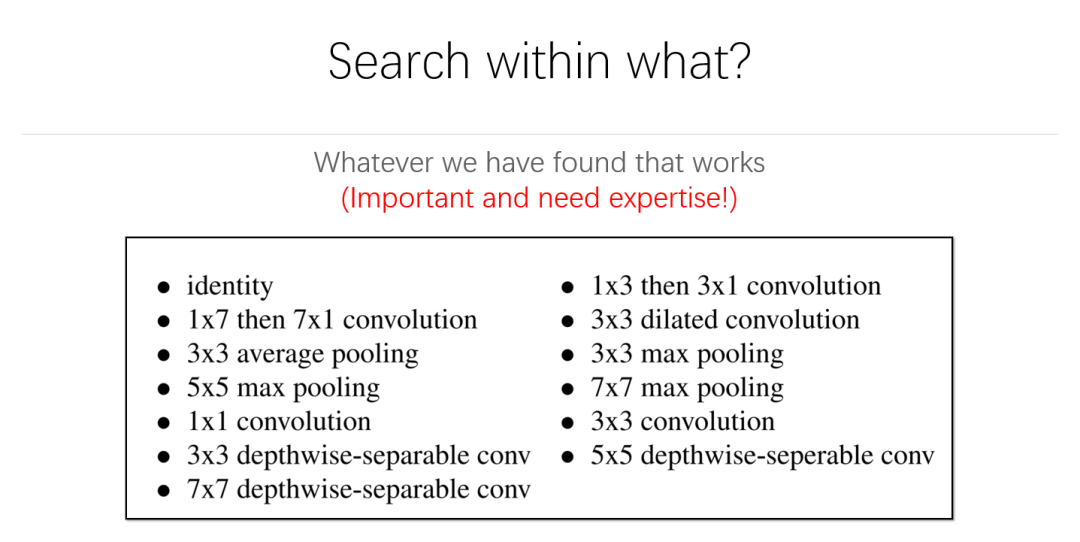

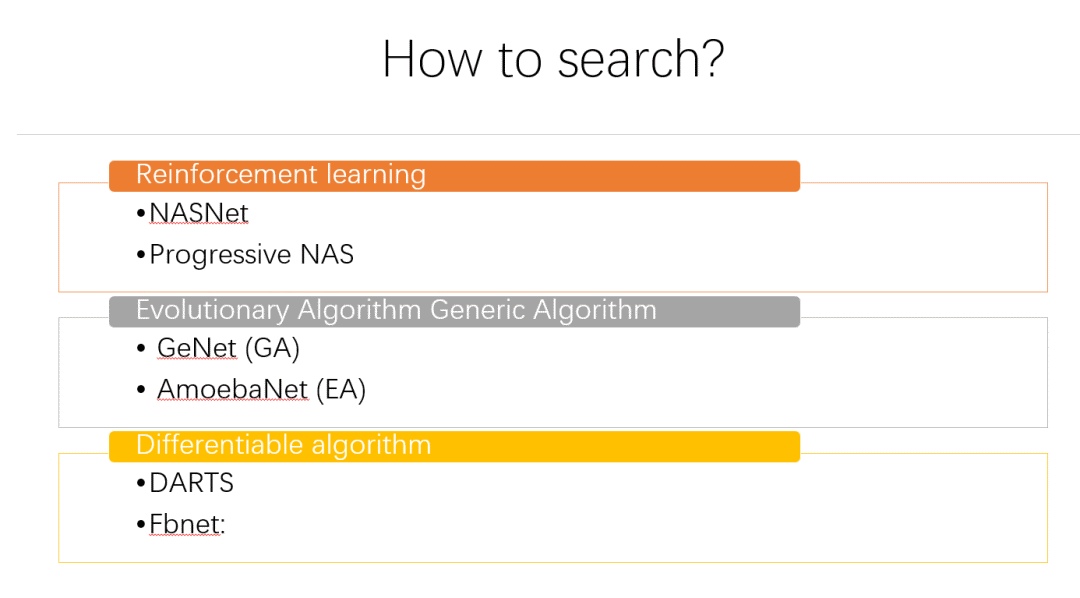

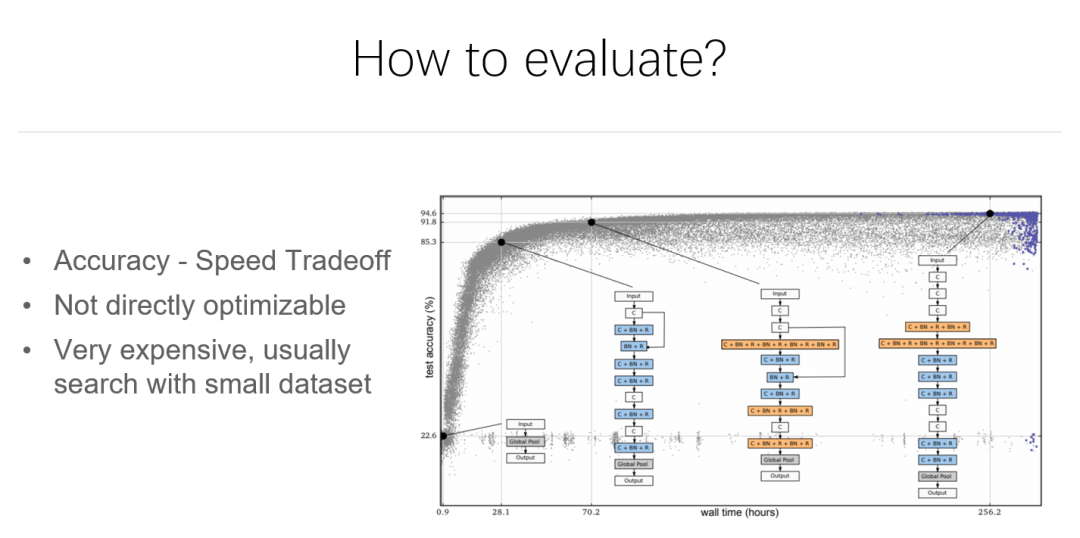

网络架构搜索的What and How

动态神经网络

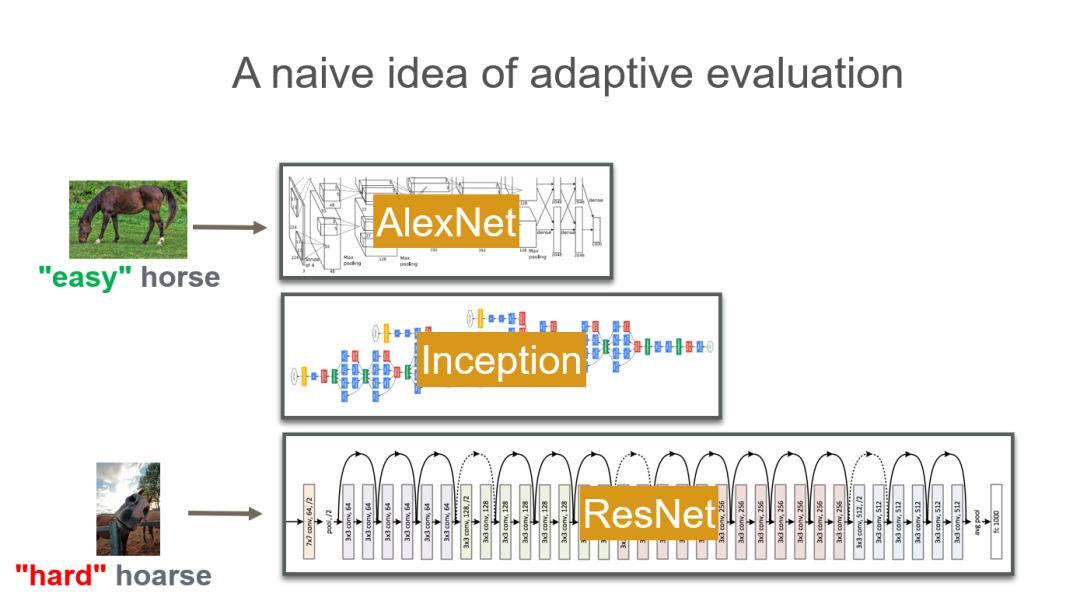

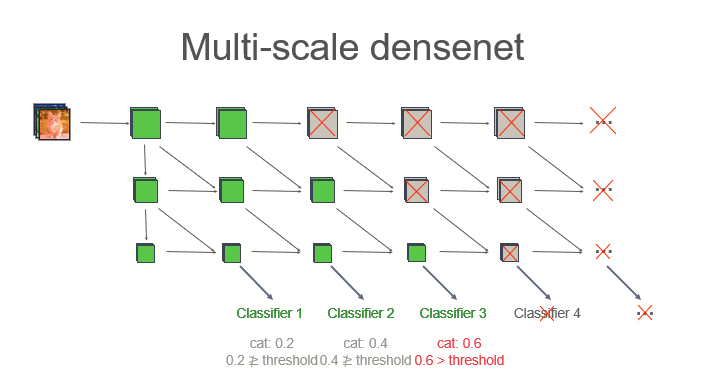

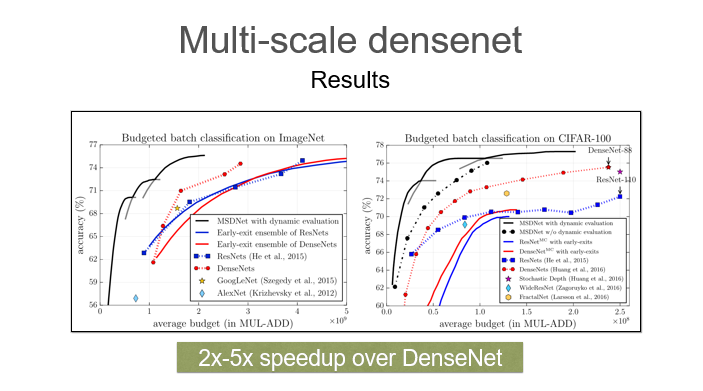

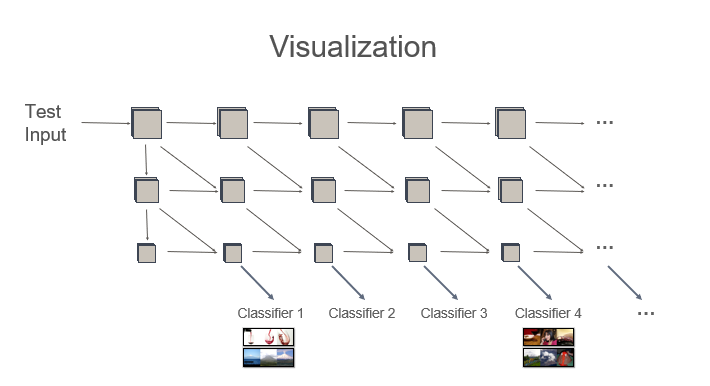

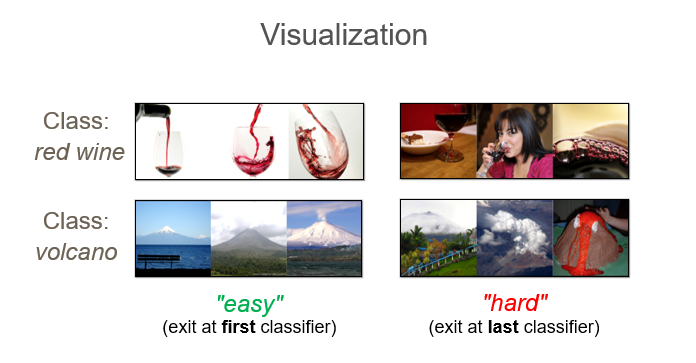

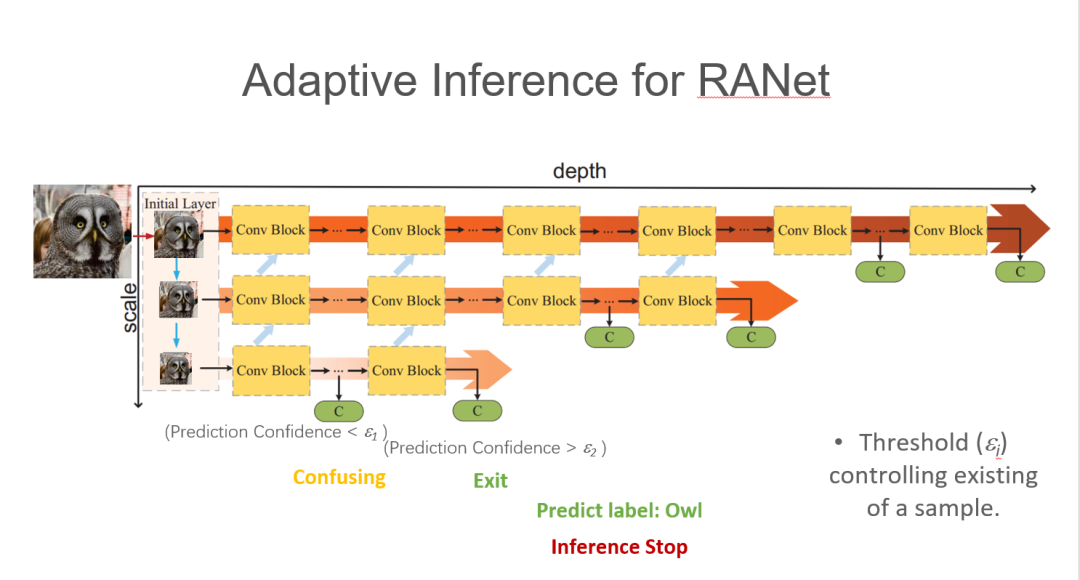

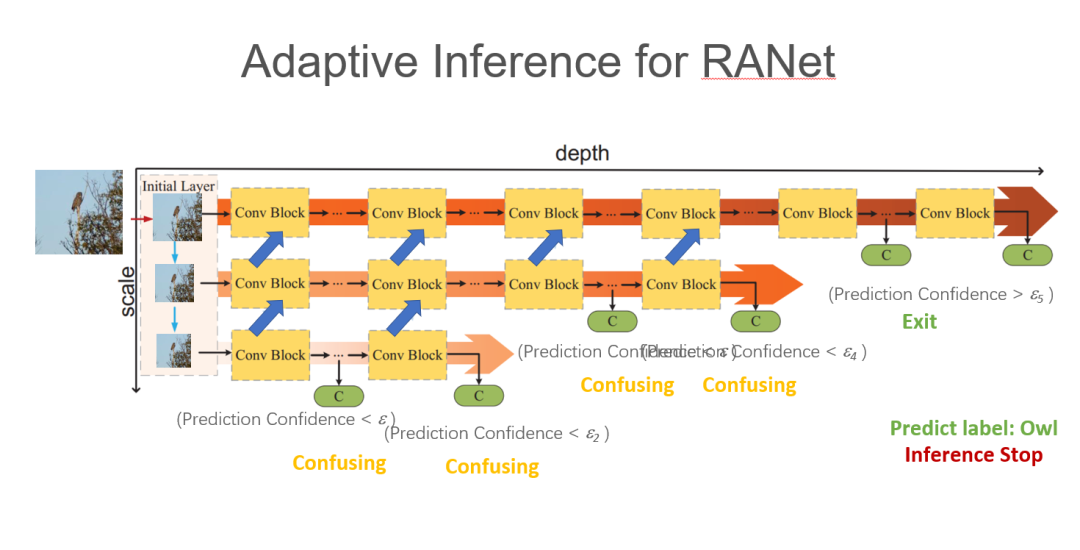

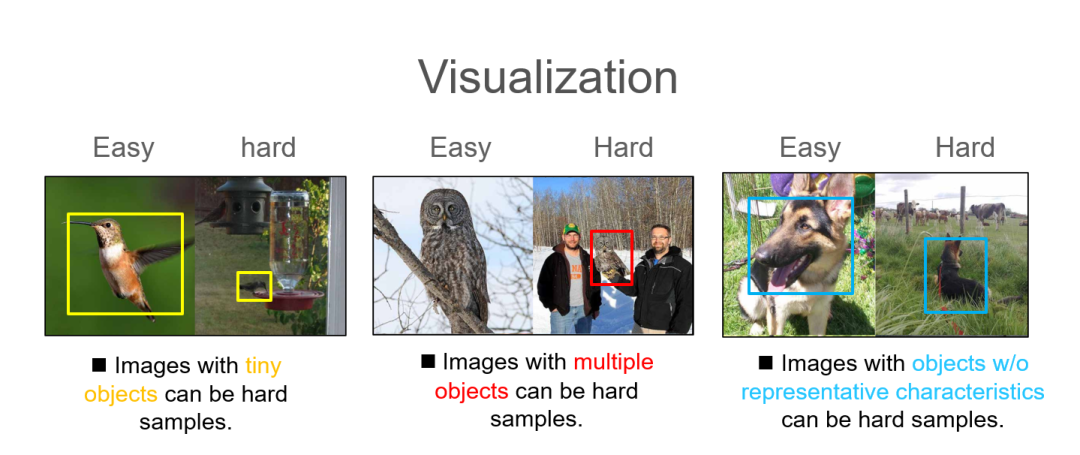

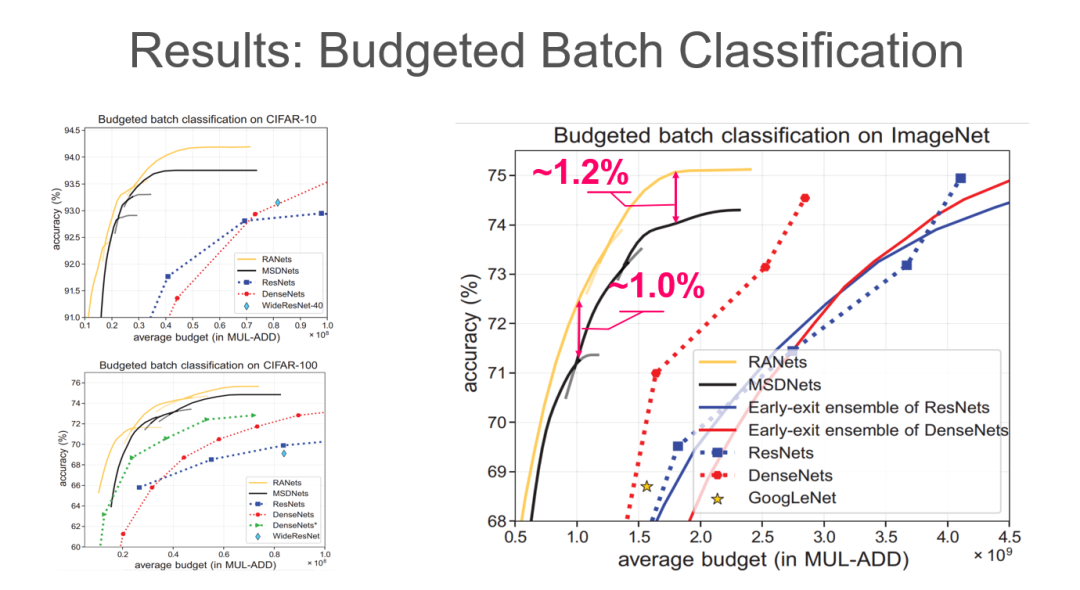

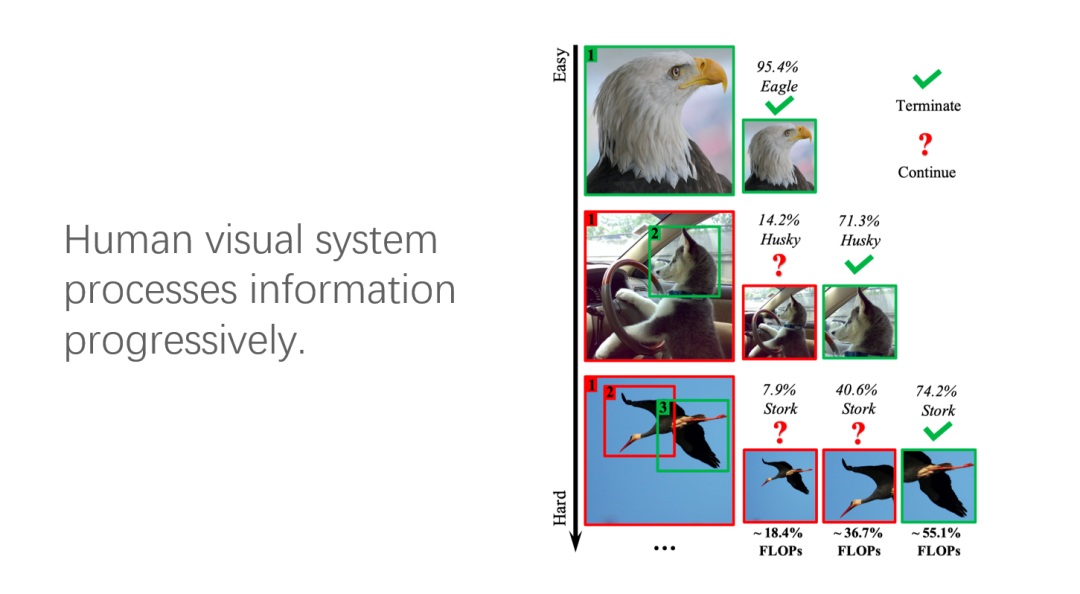

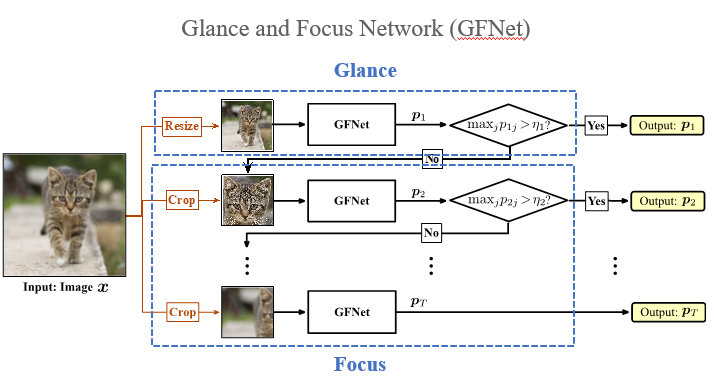

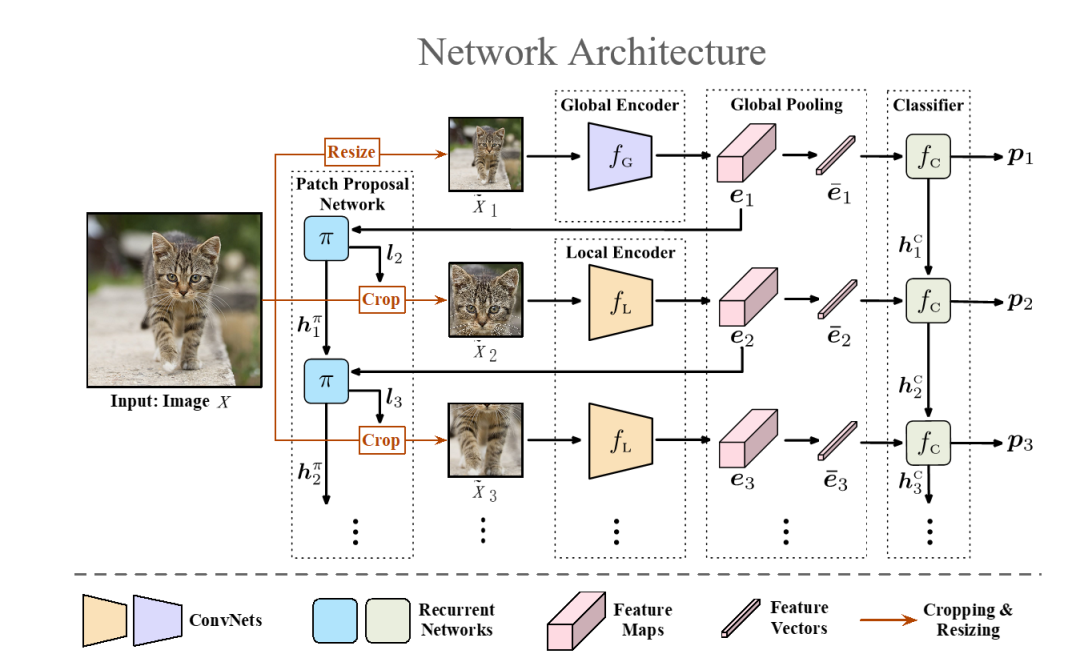

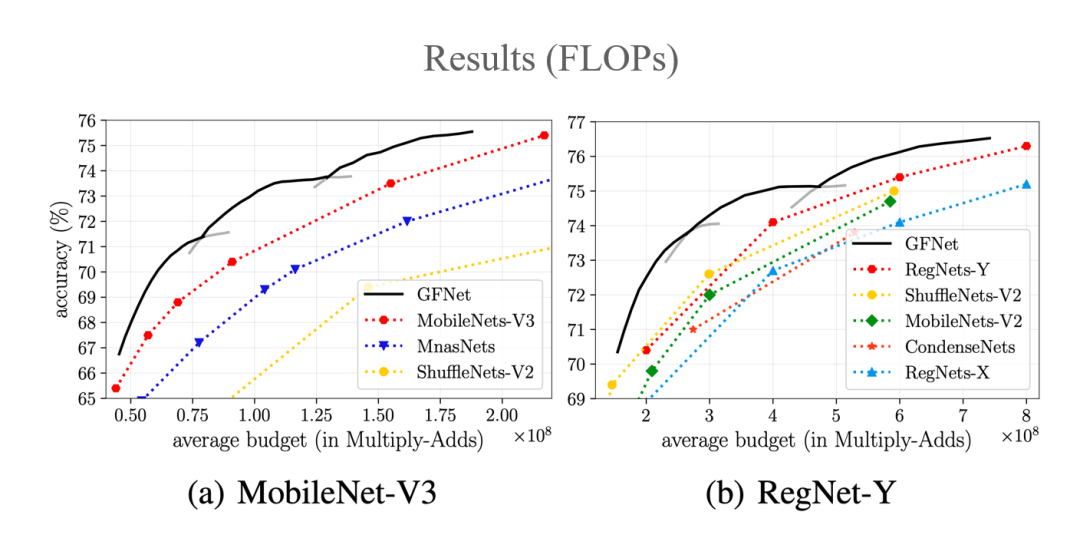

1、Small - Easy,Big - Hard

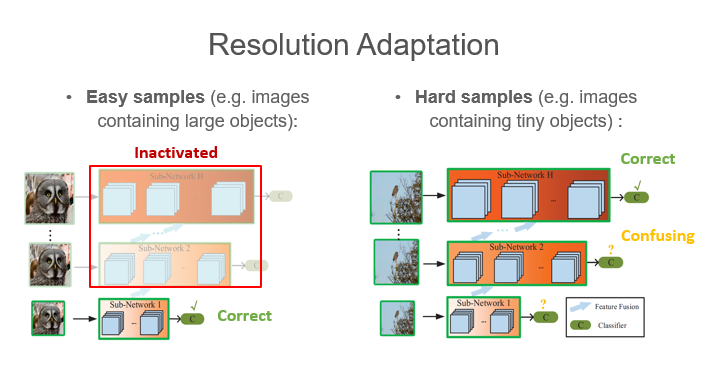

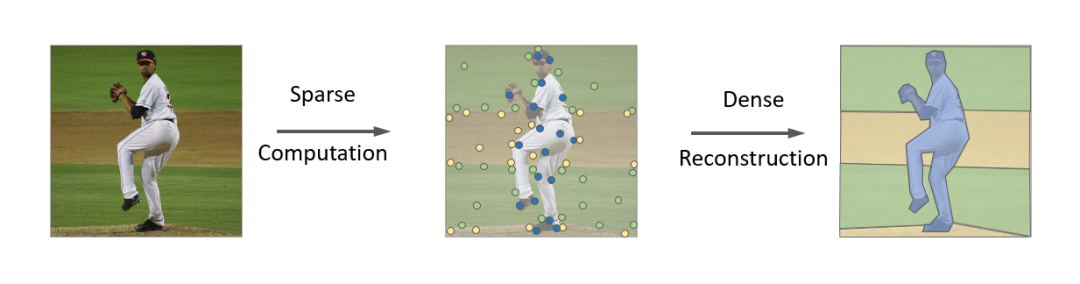

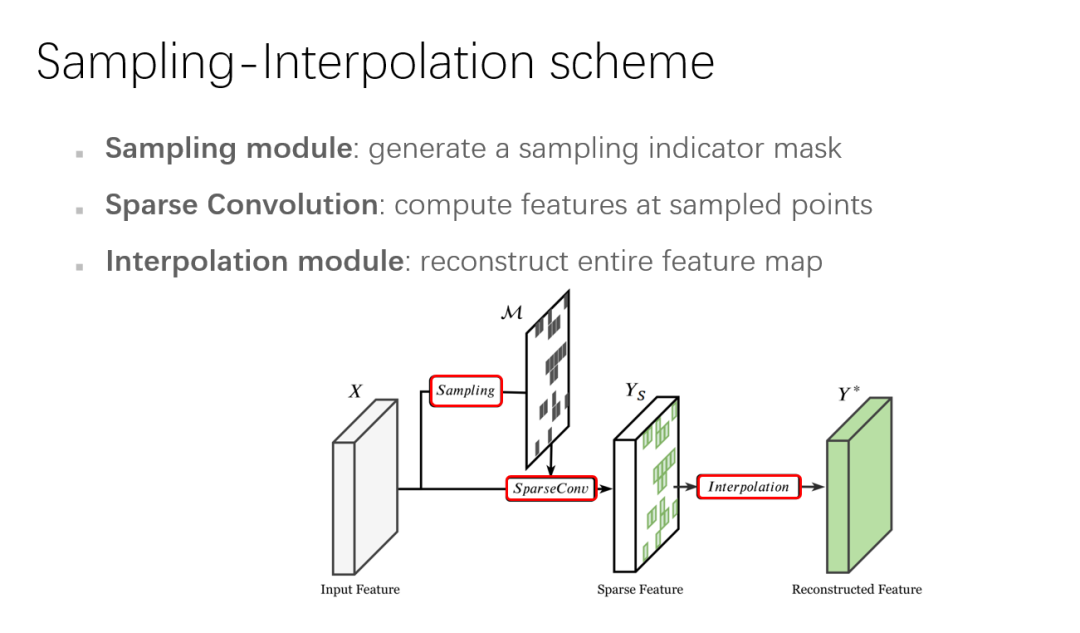

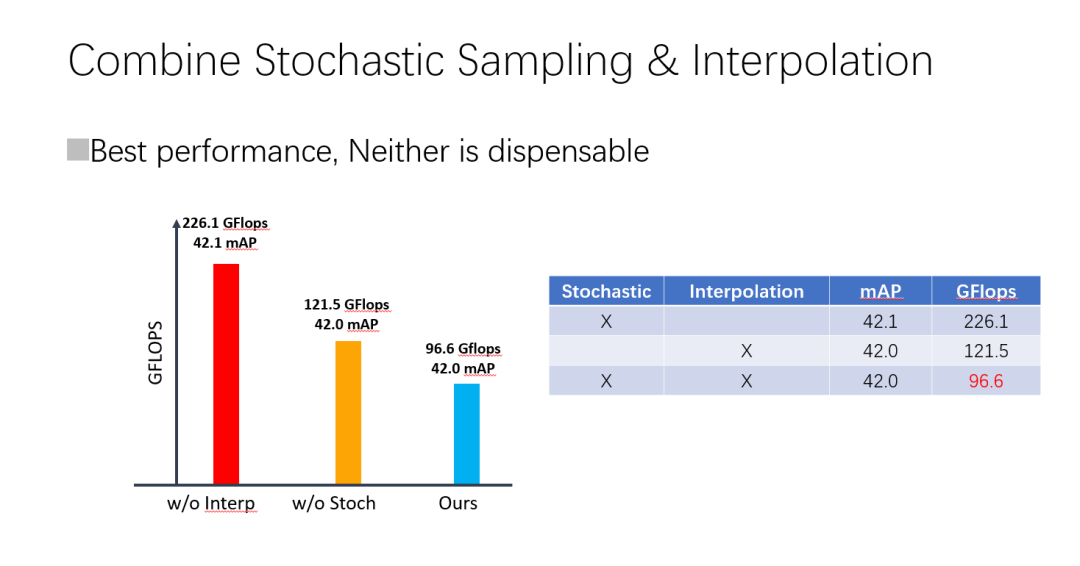

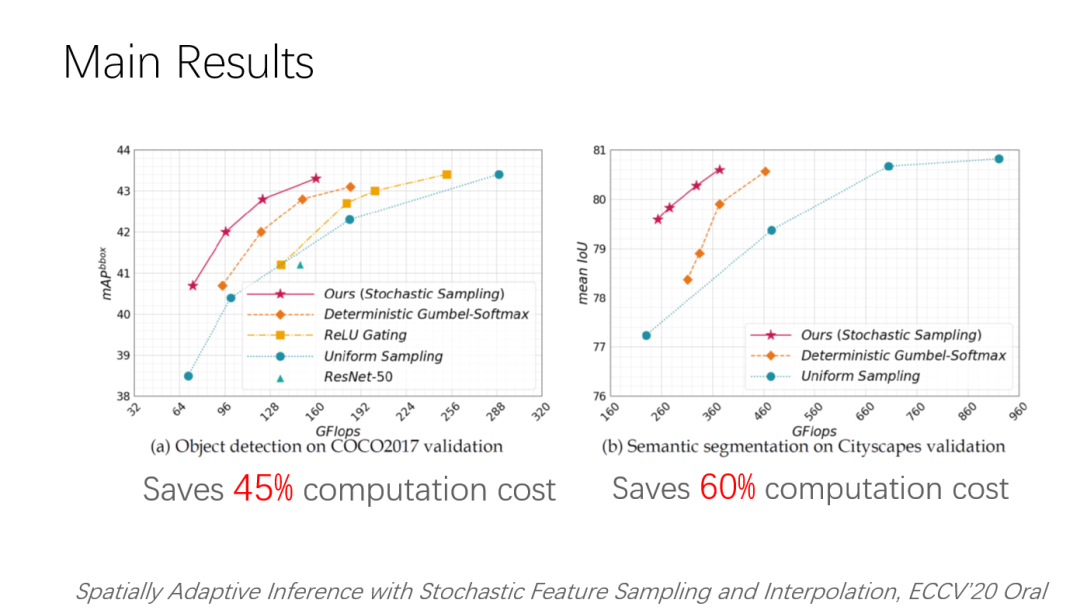

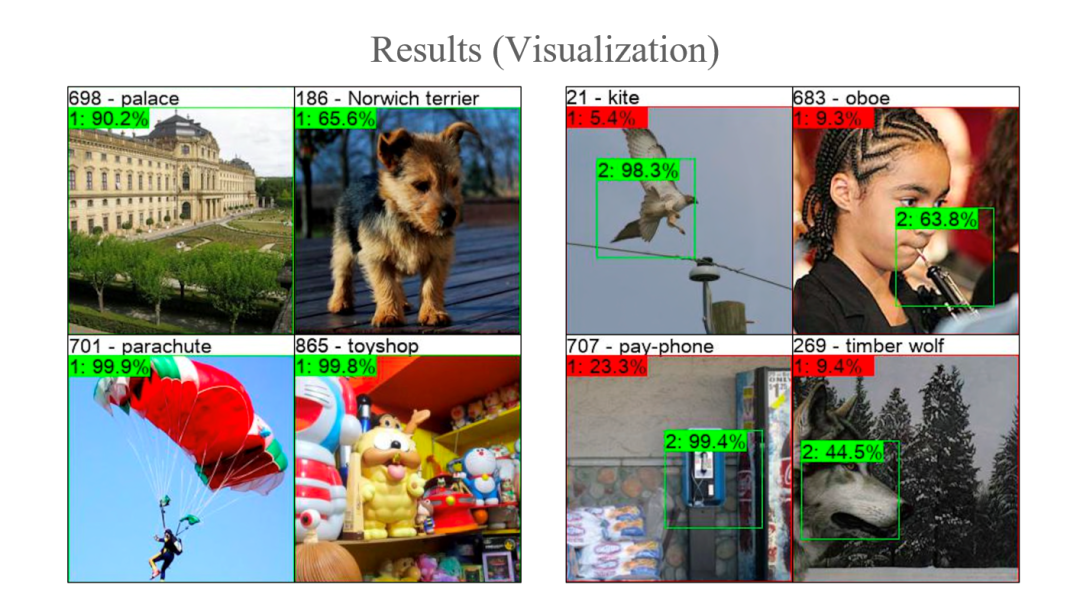

2、更进一步:空间自适应

研究需要韧性

[1] Huang, Gao, et al. "Densely connected convolutional networks." Proceedings of the IEEE conference on computer vision and pattern recognition. 2017.

[2] Wang, Yulin, et al. "Glance and Focus: a Dynamic Approach to Reducing Spatial Redundancy in Image Classification." Advances in Neural Information Processing Systems 33 (2020).

[3] Huang, Gao, et al. "Multi-scale dense networks for resource efficient image classification." arXiv preprint arXiv:1703.09844 (2017).

[4]Xie, Zhenda, et al. "Spatially Adaptive Inference with Stochastic Feature Sampling and Interpolation." arXiv preprint arXiv:2003.08866 (2020).

点击“阅读原文”,直达直播页面

由于微信公众号试行乱序推送,您可能不再能准时收到AI科技评论的推送。为了第一时间收到AI科技评论的报道, 请将“AI科技评论”设为星标账号,以及常点文末右下角的“在看”。