厘清因果逻辑后的机器学习可以脱胎换骨吗?

机器学习的难关——因果分析。

人类与机器学习的一大不同即人类理解因果逻辑容易,机器学习理解因果却难如登天。机器学习算法,尤其是深度神经网络,擅长从大量数据中找出微妙的模式,但它们很难做出简单的因果推论,主要涉及的难题是独立和恒等分布数据(i.i.d)

来看看厘清因果关系对机器学习有哪些好处、研究人员们提出了哪些有望克服这一难题的方法吧。

当看到一个棒球运动员击球时,你可以推断出不同元素之间的因果关系。例如,虽然球棒和运动员的手臂同步移动,但你清楚之间的因果关系是手臂带动了球棒的移动而非相反。同样,球的方向的突然改变是由球棒带来的,这也是简单明了的因果逻辑。你可能还会再进一步反向思考,比如球飞得高一点没有打到球棒上会发生什么。

这些推论是我们人类的直觉,不需要明确的指导,通过观察就可以理解认知是我们在很小的时候就学会的技能。但对于在围棋、国际象棋等复杂任务中成功超越人类的机器学习算法来说,因果关系仍然是一个挑战。

机器学习算法,尤其是深度神经网络,擅长从大量数据中找出微妙的模式。它们可以实时转录音频,标记每秒数千张图像和视频帧,并检查X射线和核磁共振扫描的癌症模式。但他们很难做出简单的因果推论,就像我们在上面谈到的棒球例子中那样。

论文入口: https://arxiv.org/abs/2102.11107

为什么机器学习模型不能超越其狭窄的领域和训练数据?

“机器学习经常忽略动物大量使用的信息:自然环境中的干预、域的转化、时间结构——总的来说,我们认为这些因素是讨厌的并试图把它们处理掉,”论文的作者写道,“与此相一致的是,目前机器学习的大多数成功都归结为对独立和恒等分布数据(i.i.d)进行的大规模模式识别。”

一个常见的机器学习术语i.i.d.假设问题是空间中的随机观测不相互依赖,且有恒定的发生概率。关于i.i.d.最简单的例子就是抛硬币或掷骰子。每一次新的投掷结果都是独立于之前的,并且每个结果的概率保持不变。

解决这些问题的途径主要包括在更多的例子上模型,但是随着外界变得越来越复杂,通过增加更多的训练示例来覆盖整个分布变得不再可能。在人工智能必须与外界互动的领域,如机器人和自动驾驶汽车领域情况尤其如此。

缺乏对因果关系的理解使我们很难做出预测,也很难处理新情况。这就是为什么你会看到自动驾驶汽车在经过数百万英里的训练后仍然会犯一些奇怪和危险的错误。

“要在i.i.d.环境之外很好地进行概括不仅需要学习变量之间的统计关联,还需要学习一个潜在的因果模型。”

因果模型还允许人们将获得的知识用于新的领域,例如,当你学习了《魔兽争霸》,你可以快速地将你的知识应用到其他类似的游戏《星际争霸》和《帝国时代》中。相对的,机器学习算法中的迁移学习仅限于非常浅层的用途,如微调图像分类器以检测新的对象。在更复杂的任务中,如学习电子游戏,机器学习模型需要大量的训练,并且对环境的微小变化反应 (例如,在新地图上玩或接受规则的微调)。

与行业领先企业创新官探讨应用场景的机会来咯

点击上图了解详情,4月5日截止报名,赶快上车啦!

那么,为什么尽管i.i.d.有明显的弱点,它仍然是机器学习的主导形式呢?

纯粹基于观察的方法是可扩展的,你可以通过添加更多的训练数据来继续实现精度的提高,还可以通过提高计算能力来加速训练过程。事实上,最近深度学习取得成功的关键因素就是更多数据的可用性和更强大的处理器。

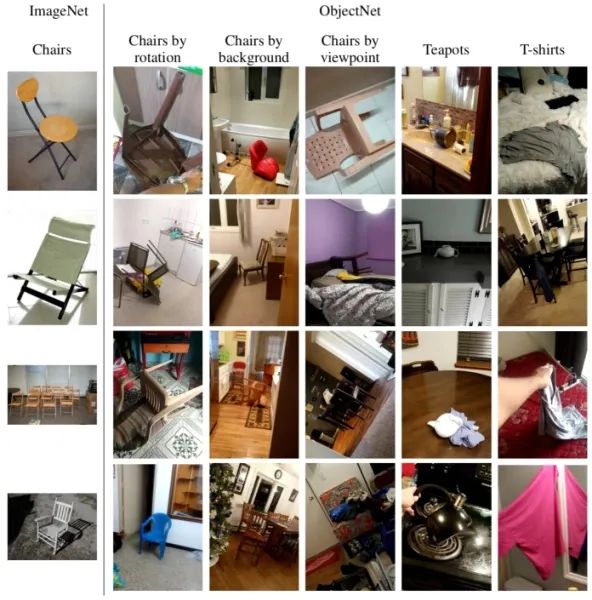

此外,基于i.i.d.的模型易于评估,将一个大型数据集拆分为训练集和测试集,在训练集上调整模型,并通过测量其在测试集上的预测精度来验证其性能。这个过程可以不断反复直到达到所需的精度。已经有很多公共数据集提供了这样的基准测试,比如ImageNet、CIFAR-10和MNIST,还有特定任务的数据集如用于COVID-19诊断的COVIDx数据集和威斯康星州乳腺癌诊断数据集。

总而言之,在所有情况下挑战都是相似的,即开发一个可以根据统计规律预测结果的机器学习模型。

但正如研究人员在他们的论文中写到的那样,精确的预测往往不足以为决策提供准确信息。例如在疫情期间,许多机器学习系统失灵了,因为它们训练的是统计规律而不是因果关系。随着生活模式的改变,模型的准确性逐渐下降。

当一个问题的统计分布改变时,因果模型仍然是稳健的,例如,当人第一次看到一个物体时,他的大脑会下意识地把光线效果纳入考量,这就是为什么当一个人在新的光照条件下看到同一个物体时可以认出它。

因果模型还允许我们对我们之前没见过的情况做出反应,并思考反向事实,如我们不需要把车开下悬崖才知道会发生什么。反向事实在减少机器学习模型所需的训练实例数量方面发挥重要作用。

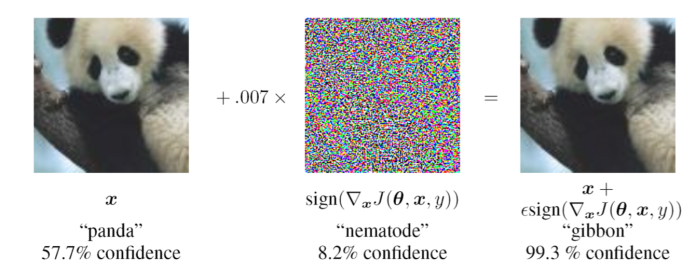

因果关系在处理对抗性攻击时也有关键作用。“这些攻击显然违反了作为统计机器学习基础的i.i.d.假设,”论文作者写道,并补充说,对抗性漏洞证明了人类智能和机器学习算法的鲁棒性机制存在差异。研究人员还指出,因果关系可能是对抗对抗性攻击的一种可能防御。

在论文中研究人员汇集了一些概念和原则,这些概念和原则对于创建因果机器学习模型至关重要。

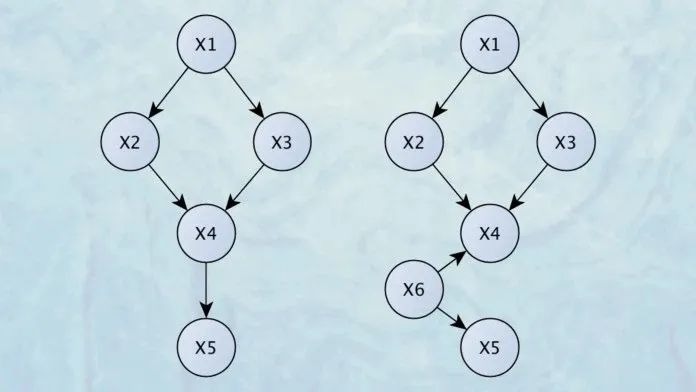

其中两个概念是“结构因果模型”和“独立因果机制”。

总的来说该原则表明,AI系统应该能够识别因果变量,并分离它们对环境的影响,而不是寻找表面的统计相关性。

这种机制在检测不同的对象时,将视角、背景、照明和其他噪音条件剥离开来。理清这些因果变量将使人工智能系统在应对不可预测的变化和干预时更加稳健。也因为如此,因果人工智能模型不需要庞大的训练数据集。

“一旦因果模型可用,无论是通过外部人类知识还是学习过程,因果推理允许它对干预、反事实和潜在结果的效果得出结论,”论文的作者写道。

作者还探讨了如何将这些概念应用于机器学习的不同分支,包括强化学习。在强化学习中,人工智能严重依赖于分析环境和通过试错发现解决方案。通过使行为主体从训练的一开始就做出明智的决定,而不是采取随机和非理性的行动,因果结构可以优化强化学习的训练。

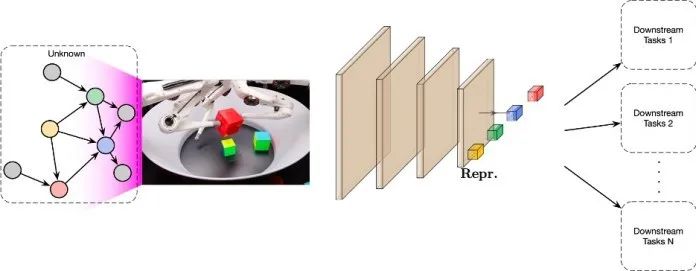

研究人员结合了机器学习机制和结构因果模型:“结合结构因果建模和表达学习,我们应该努力将SCM嵌入更大的机器学习模型,其输入和输出可以高维非结构化,但其内部运作至少部分由SCM(也可以用神经网络参数化)控制。其结果可能是一个模块化的架构,不同的模块可以单独调整并用于新的任务。”

这些概念使我们更接近于人类思维的模块化方法,在大脑的不同领域和区域间连接知识和技能。

然而,值得注意的是,本文中提出的想法是在概念层面上的。正如作者所承认的,实现这些概念需要面对以下几个挑战:

(a)在许多情况下,我们需要从可用的低级输入特征中推断出抽象的因果变量;

(b)对于数据的哪些方面显示了因果关系没有达成共识;

(c)普通的测试集、实验方案不足以根据现有数据集推断和评价因果关系,可能需要建立新的基准;

但有趣的是,研究人员从该领域的许多并行工作中获得了灵感。论文包含了朱迪亚·珀尔所做的工作,他是一位获得图灵奖的科学家,以其在因果推理方面的工作而闻名。珀尔直言不讳地批评纯粹的深度学习方法。

本文还包含了一些与加里·马库斯提出的混合人工智能模型相重叠的想法,该模型将符号系统的推理能力与神经网络的模式识别能力相结合。然而,这篇论文并没有直接提到混合动力系统。

该论文也符合system 2深度学习,这是本吉奥在2019人工智能大会上首次提出的概念。system 2深度学习背后的理念是创建一种可以从数据中学习更高表达的神经网络架构。高级表征对于因果关系、推理和迁移学习至关重要。

虽然目前还不清楚这几种方法中哪一种能够帮助解决机器学习的因果关系问题,但来自不同思想流派的观点汇集在一起,这必然催发有趣的结果。

- The End -

4月5日截止报名!赶快上车吧!

扫码观看!

本周上新!

如果你也想成为讲者

▼