“向前看 莫回头”AR-HUD技术渐行渐近

你可能对汽车挡风玻璃像屏幕一样显示地图和路径规划的场景惊叹不已。借助AR-HUD(增强现实抬头显示)技术,电影里的酷炫桥段已经走进现实,挡风玻璃和车窗正在向智能屏幕演变。AR-HUD距离大规模量产还有多远?又将为自动驾驶带来哪些改变?

百度的AR-HUD智能驾驶

百度 基于AR-HUD的智能驾驶解决方案,贴合路面的导航指示标,无论转弯、并道都有着精确的图标指引。

基于增强现实(AR)技术的HUD,结合车道级定位、ADAS警示信息,正在成为汽车辅助驾驶的重要部分。

这是Apollo小度车载OS 2.0在原有的流媒体智能后视镜组件、液晶仪表盘组件、大屏智能车机组件和小度车载机器人组件4个组件基础上新增的智能挡风玻璃(AR-HUD)组件。

小度车载OS搭载的AR-HUD依托百度高精度定位、地图信息、大数据和AI技术、以及百度地图超过5亿的用户出行大数据,能够实现精准的导航定位。

目前,全球主要汽车零部件制造商都在加大AR-HUD的技术投入和商业化产品落地,过去包括大陆集团、哈曼、LG、松下、伟世通和Wayray等都在这项技术上展示过自己的产品。百度演示的AR-HUD技术正是来自于一家国产AR-HUD厂商——疆程。

由于增强现实抬头显示器(AR-HUD)通过内部特殊设计的光学系统将图像信息精确地结合于实际交通路况中,从而扩展增强了驾驶者对于实际驾驶环境的感知。

结合目前ADAS及自动驾驶技术在量产车上的快速渗透,AR-HUD技术在L3级及以下自动驾驶阶段,能够强化驾驶安全性,增强人机交互的体验。

此前,前装W-HUD需要在汽车出厂前在挡风玻璃中间加入一块有特殊材质的楔形膜,安装成本很高,此外在重影、显像尺寸以及视觉距离等方面,还存在不少问题。

AR HUD相比常见的C、W型HUD,则有着显示清晰、科技感强、同车融合度高的优势。

疆程的AR-HUD实际道路演示

疆程的AR-HUD实际道路演示

在功能上,AR-HUD主要集成了AR、导航、ADAS、仪表信息于一体,具体包括车速、档位、剩余电量、导航信息、车道偏离预警、障碍物碰撞预警等信息。

与百度合作的疆程,是一家专门从事汽车抬头显示设备设计、研发的企业, 汇集了光学、结构、硬件、软件等各个领域的资深人士。目前在AR-HUD的研发上面较为顺利,预计在2020年实现AR-HUD的量产。

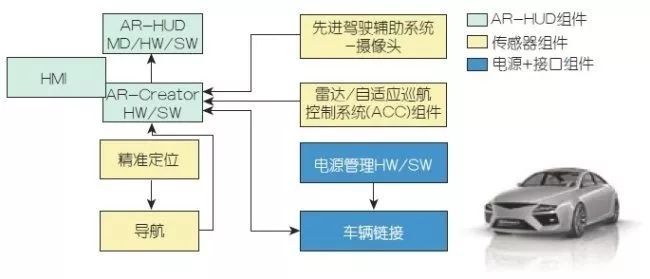

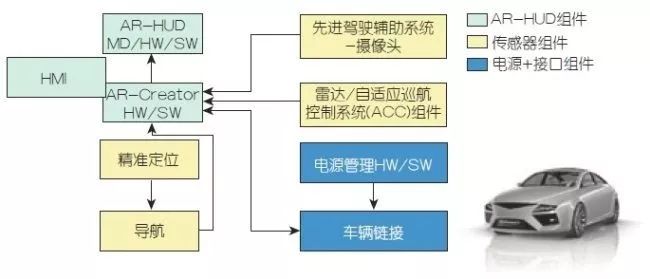

AR-HUD系统

显示系统对驾驶员看到的现实交通情况予以展延(增强):光学投影装置精确地将包含了交通状况信息的图形图像投放成外部显示。这样,AR-HUD就可以显著增强车辆的人机界面(HMI)了。

AR-HUD:所见即所知

AR-HUD的光学系统使司机能看到驾驶员辅助系统状况的增强显示、以及在其直接视域场这些信息的权重。作为人机界面的新部件,眼下的这款预生产的AR-HUD已经与驾驶员辅助系统环境传感器、以及GPS数据、地图素材和车辆动态数据等紧密整合。

雷达传感器集成在前保险杠,一个CMOS单通道摄像头(mono-camera)集成在后视镜底座。所选的相关先进驾驶辅助系统(ADAS)支持自适应巡航控制系统(ACC)、来自导航系统的道路信息、以及车道偏离警告(LDW)等最初的这些AR-HUD应用。

如果其中一个驾驶员辅助系统检测到一种相关情况,AR-HUD显示的虚拟图形信息,能使驾驶员意识到这一情况。除了直接强化了驾驶安全,这种形式的交互也是自动驾驶的一项关键技术。该增强技术使得驾驶员更容易建立起对新的驾驶功能的信任。

在AR-HUD中,可产生基于不同投影距离的两个投影面,分别称为"近端"(或"状态")面和"远端"(或"增强")面。"近端"状态面投射显示在司机前方发动机罩的前部位置,它向司机有选择地显示状态信息,例如:当前车速、需遵守的诸如禁止超车区等距离限制和限速、或自适应巡航控制系统(ACC)的当前设置等信息。司机只需降低约6°视角,就可看到这些信息。状态信息的视场大小为5°×1°(相当于210mm×42mm),投影距离为2.4m。

投影光路原理图。

投影光路原理图。

其相当于"传统"平视显示器的虚拟图像,基于反射镜光学和图像生成单元(PGU)。PGU由薄膜晶体管(TFT)显示器构成,其内容使用LED背光。PGU采用紧凑设计被集成进AR-HUD模块的上部。镜头光学对显示内容进行放大以实现虚拟呈现,它是由曲面镜实现的。大陆集团在AR-HUD内采用精心打造的光学设计实现由不同投影距离生成的两个画面。在此,这两个光路在内部稍微重叠。近端面光路只使用大的AR-HUD镜(大的非球面镜)的上部边缘区,没有另外的"折叠镜"。AR-HUD系统的这一部分类似于大陆集团集成在现产汽车的第二代HUD所用的先进技术。

借助电影技术的车辆 增强现实 显示技术

而增强面自然在AR-HUD内扮演着主角。它将增强了的显示符号直接投射在驾驶员前方7.5米处的道路上,内容会基于当前的交通状况进行调适。该远端面显示的内容是由大陆集团首次在IAA 2013展出的一款新的图像生成单元生成的。图形元素是由数字微镜器件(DMD)以与数字电影放映机相同的方式生成的。PGU的核心是由几十万微镜矩阵构成的光学半导体结构,每一微镜都可单独由静电场偏置。

该微镜矩阵由三色LED(红、绿、蓝)按时间顺序快速、连续、交替点亮。通过带滤色功能("分色镜")的偏置镜,产生平行方向的三色光视觉瞄准(collimation)。根据颜色的不同,这些特殊的微镜或允许光线通过或反射光线。处理这三种颜色的所有微镜被当前点亮的颜色所同步偏置,所以它们通过镜头反射了入射光,并在光路后面的聚焦屏上将这种颜色呈现为独立象素。对所有三种颜色来说,这是同时发生的。人眼在聚焦屏幕上对这三种彩色画面进行"调和",并得到全彩画面的主观视觉。

从聚焦屏的前面看下去,其后的光路相应于一款常规抬头显示器,其中:经由聚焦屏、使用第一个镜头(折叠镜)将图像反射到第二个更大的镜头(AR-HUD镜)的。再经由AR-HUD镜,图像被反射到前方屏幕。用于该增强功能的光学系统的射光面约为一张A4纸大小;也即,在增强级,视域相当于10°×4.8°,换算成可直接观看的增强视域约为:130cm(宽)×63cm(高)。司机只需稍微将其视线下调2.4°,就可看到该显示面信息。近端和远端这两种图像产生单元可根据环境光亮度产生不同亮度的显示,亮度可达超过10,000坎德拉/平米。因此,几乎在所有环境光条件下,都可容易地看清显示信息。

在测试车辆上的AR-HUD所采用的、在不同投影距离生成两个画面的系统方法具有显著优势。在大多数交通条件下,可同时在远端和近端面呈现内容。这就允许将所有相关的驾驶和状态信息显示在司机可直接观看的视域。

AR-Creator的数据融合和图形生成

众多的模拟和真人测试(subject tests)表明:当对从车前约18到20米开始、并接续到大约100m的这段道路实现增强时,驾驶员感觉最爽,当然这还与路况相关。AR-Creator控制单元必须评估若干传感器数据流以将图形元素投放在聚焦屏的确切位置,再经由聚焦屏,这些图形被精确地反射进司机的AR-HUD视域。这需要大量运算。

AR-Creator将三个来源的数据进行融合。单通道摄像头提供道路布局的几何形状。还将"羊角曲线(Euler spirals)"或车辆前方车道曲率如何变化的数学描述考虑在内。基于雷达传感器数据和对相机数据的解释这两个因素综合判断车辆前方可检测目标的大小、位置和距离。最后, 在地图框架内读取感知的现场数据。在AR-HUD上显示的多种(即来自车到车、交通控制中心等的)数据源。整合了车辆动态信息、摄像头和GPS数据后,可在数字地图上显示车辆的位置。

AR-Creator还利用合并的数据来计算:从驾驶员的位置,观察前面道路的几何布局会是怎样一种情况。因为已知驾驶者的眼位置,所以这是可能的。在开始驾车前,驾驶员要在演示车辆设置"眼睛盒(eye box)"的正确位置。该过程可由批量生产(series production)的内部相机自动完成。该摄像头可检测驾驶员眼睛的位置,并可以跟踪眼睛盒的位置。术语"眼睛盒"表示一种矩形区域,其高度和宽度相当于理论上的"视窗"。当通过该视窗查看道路时,驾驶员只会看到完整的AR-HUD画面。车内乘客看不到HUD和AR-HUD显示的内容。

基于可调节眼镜盒的位置,AR-生成器"知道"驾驶员的眼睛所在,以及驾驶员在从哪个角度查看道路和周围环境。如果辅助系统报告一个相关观察,相应的虚拟信息就会出现在AR-HUD的正确点上。

AR-HUD的应用尚需解决的问题

1、首先是虚拟内容和实际行车环境的自然叠加。

在AR-HUD兴起之前,已经有汽车厂商将投影设备与行车电脑相连,实现导航信息的抬头显示。与普通HUD只需要解决挡风玻璃弧度引起的图像畸变相比,AR-HUD必需和物理世界无缝融合。例如,当车辆与前车距离过近,传统HUD会发出警告信息,AR-HUD会将前车车位标红并显示规避路线;当车辆需要转到高速出口时,AR-HUD会在转弯启动和到达的位置标出路径箭头,让驾驶员可以“不假思索”地执行,提升决策效率。

随着算法和汽车传感器精度的增加,未来的AR-HUD不会让驾驶员感到信息叠加在玻璃上,而是叠加在现实世界中。

2、其次是交互问题。

在《碟中谍4》中,特工通过触控挡风玻璃调出地图。但是在现实世界中,触控或手势交互容易对行车安全造成影响。目前较为成熟的方案是语音交互,但语音交互会打扰同车乘客。将语音、触控、手势识别集成到一个平台上,在车内只有驾驶员时切换到语音交互,在车内有其他乘客辅助时切换其他交互方式。随着脑波、脑机VR/AR概念的兴起,未来通过脑电波控制AR-HUD或许会成为终极交互方案。

3、是显示,也就是UI设计和用户体验。

行车过程中,显示信息过于复杂会对驾驶员造成干扰,信息太简单会降低准确性,需要在UI设计上做出取舍。此外,信息如何随玻璃的明暗变化实时调整颜色和亮度,也需要传感器和算法的辅助。

除了挡风玻璃,部分厂商也将目光投向其他车窗。例如,通用汽车推出的AR原型车窗,通过触觉反馈系统创建外部事物的触觉描述,支持乘客在玻璃上为外部风景添加想要的元素。梅赛德斯也推出过显示AR画面的虚拟车窗概念车。借助AR技术,未来汽车的前后挡风玻璃和车门玻璃都可以成为屏幕,构建真正的智能驾驶空间。

AR在“车窗交互”应用前景光明

Marketsand Markets最新报告显示,AR市场规模预计将从2018年的110亿美元增长至2023年的600亿美元。而2016年全球前装 HUD市场规模为5.6亿美元,同比增长33%,预计到2020年市场规模将达到17.8亿美元。

HUD与AR的广阔市场,以及“车窗交互”的应用前景,让AR-HUD逐渐成为科技巨头构建生态的新抓手。

制造业的未来是智能化,智能化的基础就是传感器;互联网的方向是物联网,物联网的基石也是传感器;

【点击蓝色标题,获取文章】

3、一文读懂磁传感器

10、一文读懂光纤传感器

11、一文读懂温湿度传感器

12、一文读懂图像传感器

13、一文读懂生物传感器

14、一文读懂霍尔传感器

15、一文读懂距离传感器

16、一文读懂氧传感器

17、一文读懂风向风速传感器

18、一文读懂纳米传感器

19、一文读懂红外传感器

21、一文读懂气体传感器

23、汽车传感器今日谈

24、一文读懂手机传感器

25、一文读懂医疗传感器

26、一文读懂化学传感器

28、一文读懂换能器

29、一文读懂旋转编码器

30、一文读懂变速器

31、一文读懂振动传感器

32、一文读懂电容传感器

33、一文读懂电涡流传感器

34、一文读懂电感式传感器

35、一文读懂光栅传感器

36、一文读懂压电式传感器

37、一文读懂烟雾传感器

38、一文读懂电阻式传感器

39、无线网路传感器详解

为您发布产品,请点击“阅读原文”