CVPR'21 | 大幅涨点!孙剑团队提出新激活层ACON和轻量级网络TFNet

CVPR 2021 文章专题

第·14·期

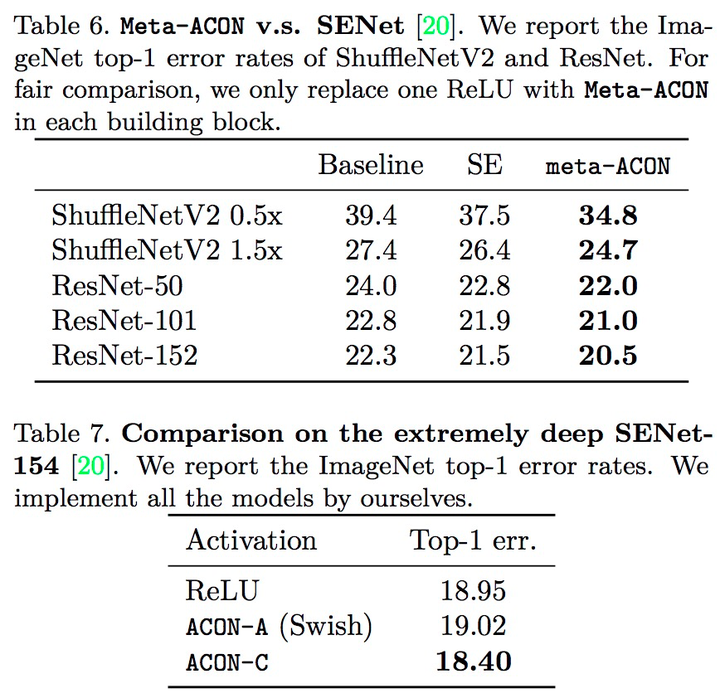

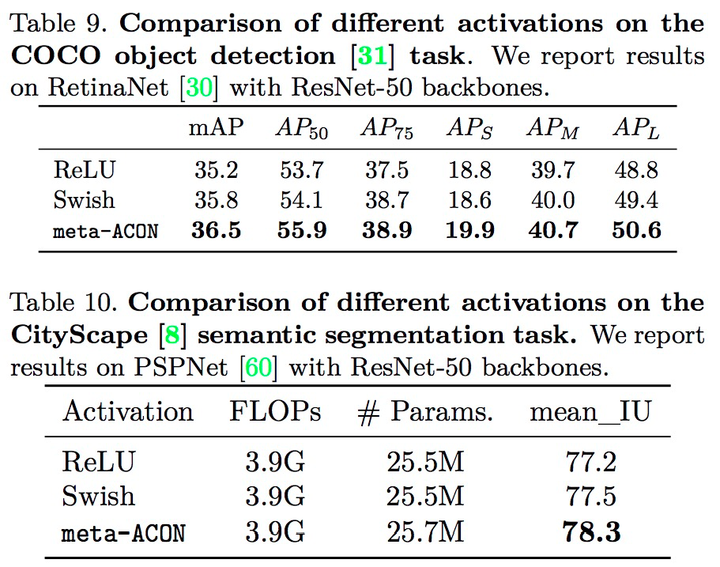

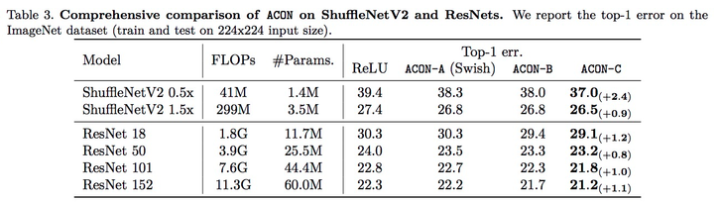

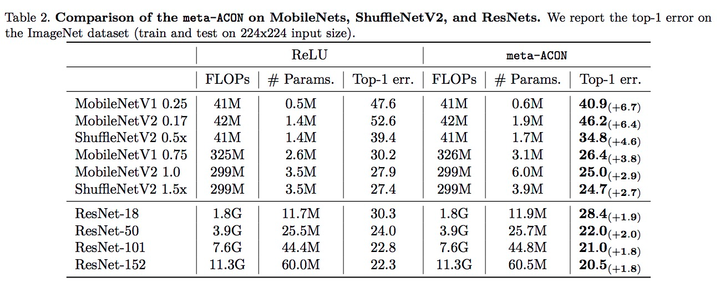

本文在多个任务上验证了此方法的涨点性能和泛化性能(例如在MobileNet-0.25和ResNet-152上,分别将ImageNet准确率提高了6.7%和1.8%),这表明ACON对已有的激活函数中是一种有效的替代方法。

知乎原文:

https://zhuanlan.zhihu.com/p/363274457

论文链接:

https://arxiv.org/pdf/2009.04759.pdf

代码:

https://github.com/nmaac/acon

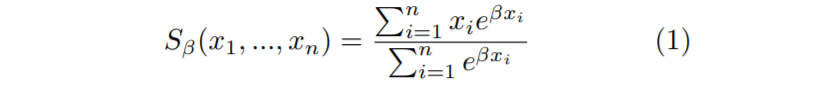

这里引入了一个  ,它控制着

,它控制着  的平滑程度:

的平滑程度:

当  时,

时,  (非线性)

(非线性)

当  时,

时,  算术平均 (线性)

算术平均 (线性)

的作用:

的作用:

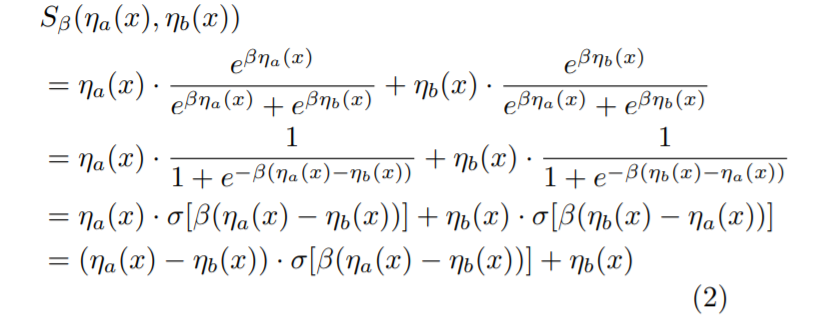

分别代表这两项:

分别代表这两项:

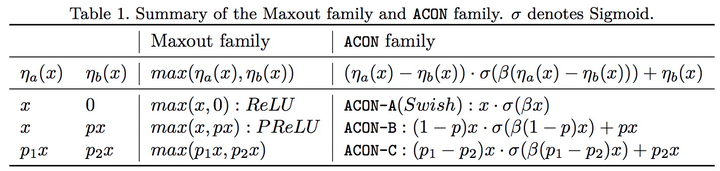

代入合适的值,有意思的事情就发生了:

代入合适的值,有意思的事情就发生了:我们发现,当  时,

时, 恰好是 ReLU 的表达式,而

恰好是 ReLU 的表达式,而 又恰好是 Swish 的表达式。于是,我们可以把 Swish 解释为 ReLU 的这样一种平滑近似。

又恰好是 Swish 的表达式。于是,我们可以把 Swish 解释为 ReLU 的这样一种平滑近似。

二、ReLU的一般式和Swish的一般式的关系

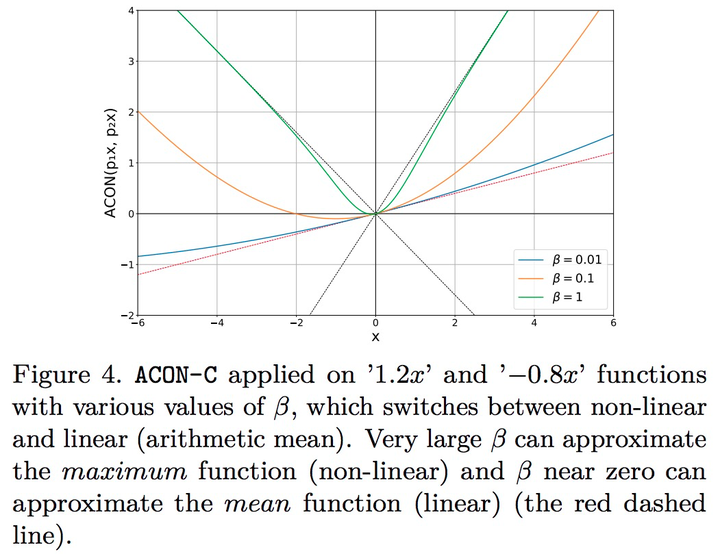

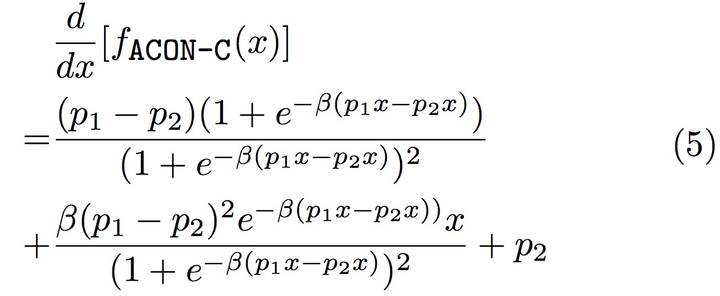

代入不同的值,得到上表中的不同形式,我们着重分析ACON-C,计算它的导数:

代入不同的值,得到上表中的不同形式,我们着重分析ACON-C,计算它的导数:

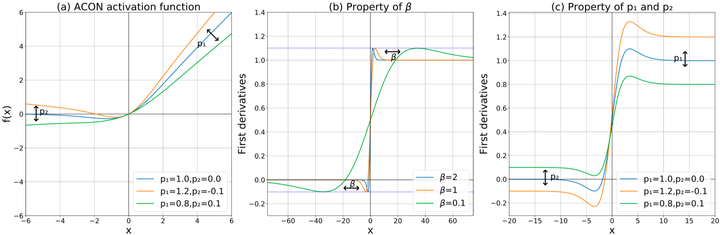

, 我们画出下图来更直观的理解它。可以发现在一阶导中,

, 我们画出下图来更直观的理解它。可以发现在一阶导中, 控制着其渐进上下界的速度,而

控制着其渐进上下界的速度,而  则控制着上下界的值,这一点是Swish所欠缺的,后面的实验也会证明

则控制着上下界的值,这一点是Swish所欠缺的,后面的实验也会证明  的重要性。

的重要性。

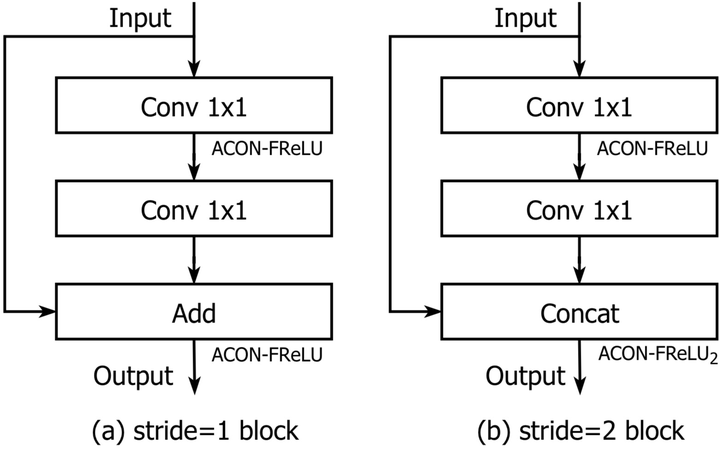

三、ACON 的更多特例 ACON-FReLU

的不同取值做了分析。最近专门针对视觉任务的新激活函数 FReLU (Funnel Activation for Visual Recognition) 也是Maxout的一种特例,本文设

的不同取值做了分析。最近专门针对视觉任务的新激活函数 FReLU (Funnel Activation for Visual Recognition) 也是Maxout的一种特例,本文设 后,得到了 ACON-FReLU,并且基于此模块,设计了一个仅由 Conv1x1 和 ACON-FReLU 组成的轻量级block:

后,得到了 ACON-FReLU,并且基于此模块,设计了一个仅由 Conv1x1 和 ACON-FReLU 组成的轻量级block:

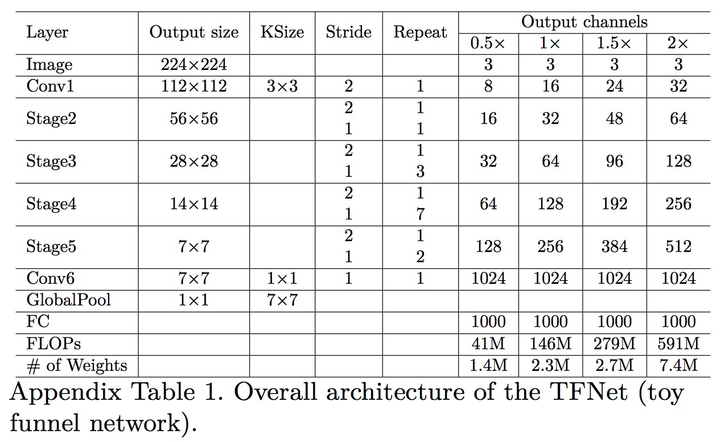

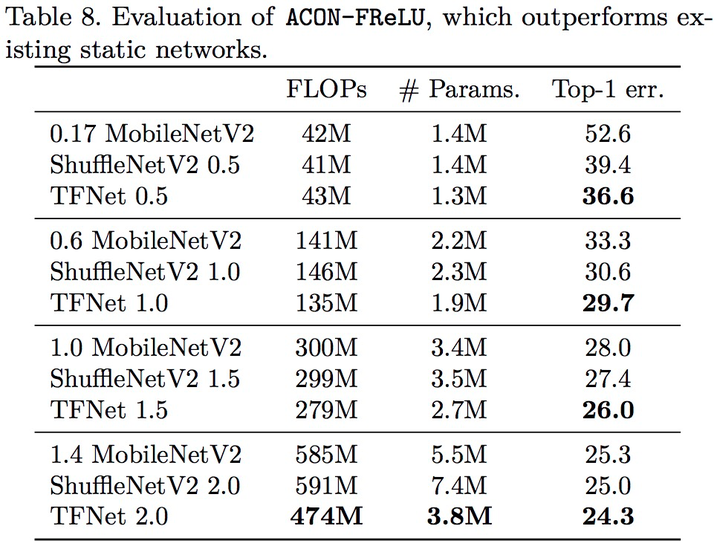

以此 block 为基础搭建了 Toy Funnel Network (TFNet),来验证 ACON-FReLU 的有效性:

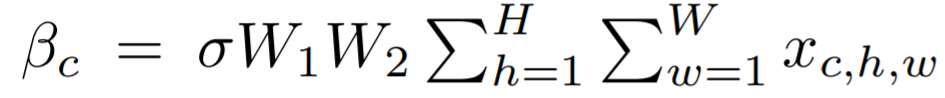

四、Meta-ACON

的不同变体着重做了分析,但前面提到

的不同变体着重做了分析,但前面提到  也同样重要因为其控制了激活程度。然而,从实验结果来看,在 Swish 的原始文章中也提到,

也同样重要因为其控制了激活程度。然而,从实验结果来看,在 Swish 的原始文章中也提到, 作用不大,即使

作用不大,即使  固定为1(Swish-1),也能取得差别不大的性能。

固定为1(Swish-1),也能取得差别不大的性能。 的分析相违背,于是,本文对

的分析相违背,于是,本文对  用非常简单直接的小网络结构去生成,即显式地学习激活程度而不仅仅是把

用非常简单直接的小网络结构去生成,即显式地学习激活程度而不仅仅是把  作为一个参数,这样就解决了

作为一个参数,这样就解决了  效果不大的问题:

效果不大的问题:

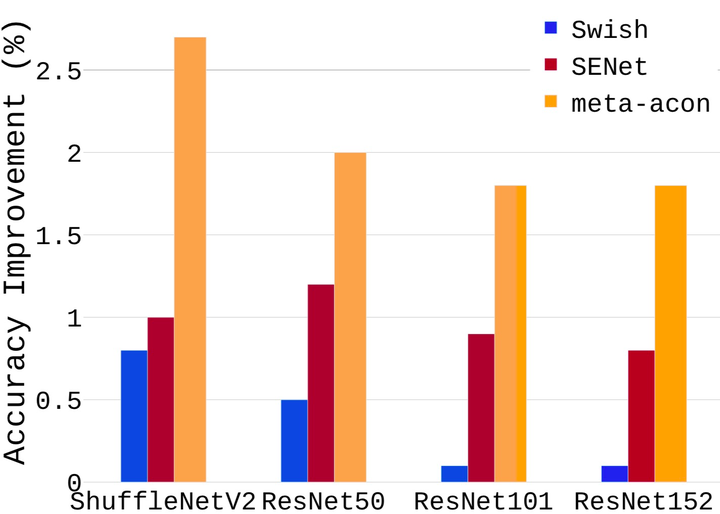

在大模型和小模型都能有非常显著的涨点,且随着模型变大,涨点效果没有明显减弱

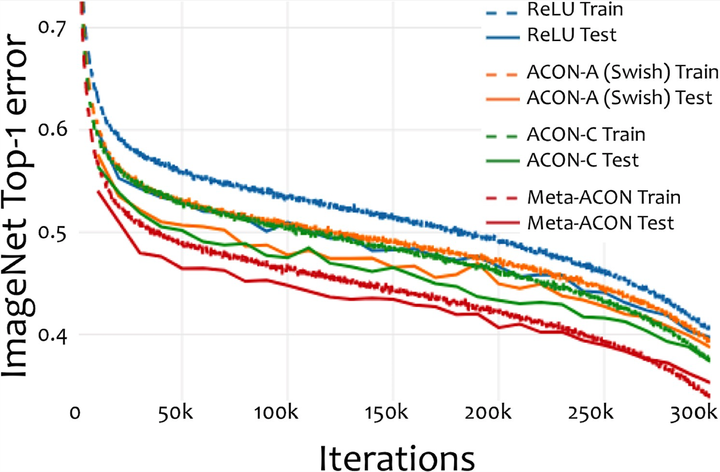

从学习曲线可以看到ACON-C相比于Swish的优势在于后期仍能有提升,Meta-ACON则效果跟为显著

CVPR 2021 论文解读 ●●

// 1

// 2

// 3

// 4

// 5

// 6

// 7

// 8

// 9

// 10

// 11

// 12

// 13

扫码观看!

本周上新!